Die operative Implementierung agentischer KI-Systeme offenbart ein architektonisches Paradoxon: Die maximale Effizienz dieser Modelle resultiert aus ihrer Autonomie, doch genau diese Autonomie induziert signifikante systemische Vulnerabilitäten. Ohne ein steuerndes Interface mutieren autonome Agenten zu einer unkalkulierbaren Blackbox. Die drängendste Herausforderung der aktuellen Software-Ergonomie besteht folglich in der Entwicklung hocheffizienter User-Interfaces (UIs), die eine sichere Orchestrierung ermöglichen. Solange invasive Brain-Computer-Interfaces (BCIs) wie Elon Musks Neuralink nicht den Weg in die breite Masse finden – ein Szenario, das aufgrund tiefgreifender ethischer, medizinischer und pragmatischer Hürden im Enterprise-Sektor als hochgradig unwahrscheinlich einzustufen ist –, bleibt die visuelle Mensch-Maschine-Schnittstelle der absolut limitierende Faktor für die Skalierung von KI-Produktivität.

Das Interface-Dilemma agentischer Systeme Vom Prompting zur Validierung

Der klassische Chat-Prompt ist ein Artefakt der frühen LLM-Ära. Er zwingt den Menschen in eine ineffiziente „Human-to-Machine“-Dynamik, in der der Nutzer den Kontext mühsam aufbauen und den Prozess initialisieren muss. Für autonome Agenten, die im Hintergrund kontinuierlich Datenströme überwachen, Dokumente analysieren und Workflows vorbereiten, ist dieses Paradigma obsolet. Wir benötigen zwingend einen Paradigmenwechsel hin zu „Machine-to-Human“-Interfaces. In dieser invertierten Architektur übernimmt das System die Rolle des proaktiven Akteurs, der Vorschläge unterbreitet, während der Mensch ausschließlich in der Rolle des evaluierenden Supervisors agiert. Nur durch diesen strukturellen Wechsel lässt sich die kognitive Belastung (Cognitive Load) des Administrators senken und der Durchsatz verifizieren.

Ein effizientes Machine-to-Human-Interface konvertiert die stochastische Komplexität eines neuronalen Netzes in eine binäre Entscheidungsgrundlage für den menschlichen Operator: Approve oder Reject.

Dieser fundamentalen Anforderung an die Ergonomie folgend, kristallisieren sich derzeit verschiedene Interface-Typologien heraus, die darauf ausgelegt sind, die Kontrolle über agentische Systeme zu skalieren, ohne den Menschen als kognitiven Flaschenhals zu überlasten. Der nachfolgende Überblick systematisiert diese Ansätze für den produktiven Einsatz.

Typologien interaktiver KI-User-Interfaces Architekturmuster für die Systemaufsicht

Um die Lücke zwischen maschineller Autonomie und menschlicher Verifikation zu schließen, müssen Interfaces den Kontext komprimieren und Handlungsoptionen isolieren. Die nachfolgenden Ansätze stellen die derzeit effizientesten Methoden dar, um dieses Ziel technisch zu realisieren.

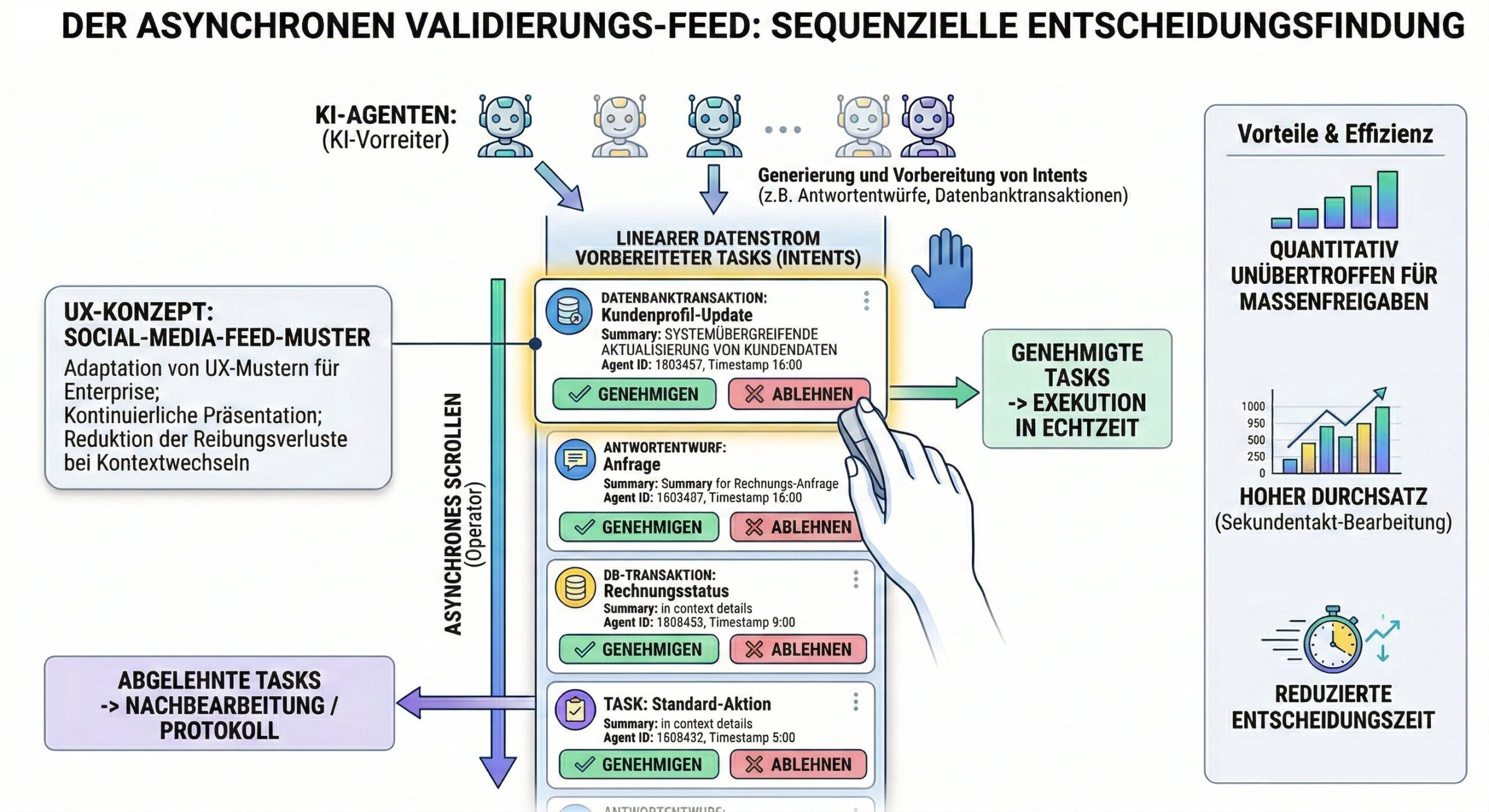

1. Der asynchrone Validierungs-Feed Sequenzielle Entscheidungsfindung

Wie bereits in der Vorstellung des OpenAMS-Kernsystems erläutert, adaptiert der Feed-Mechanismus die UX-Muster moderner Social-Media-Plattformen für Enterprise-Anwendungen. Dieser lineare, kontinuierlich aktualisierte Datenstrom präsentiert die von den Agenten vorbereiteten Intents (z.B. Antwortentwürfe, Datenbanktransaktionen) in hochgradig standardisierten Kacheln. Der signifikante Vorteil dieser Methodik liegt in der drastischen Reduktion der Reibungsverluste bei Kontextwechseln. Der Operator scrollt asynchron durch vorbereitete Tasks und genehmigt diese im Sekundentakt. Für eindimensionale, massenhaft auftretende Freigabeprozesse ist dieser Ansatz quantitativ unübertroffen.

Metrik: Der Feed-Mechanismus skaliert exzellent für hochfrequente Low-Context-Entscheidungen, stößt jedoch bei komplexen, multidimensionalen Workflows, die tiefgreifende Recherchen des Operators erfordern, an seine architektonischen Grenzen.

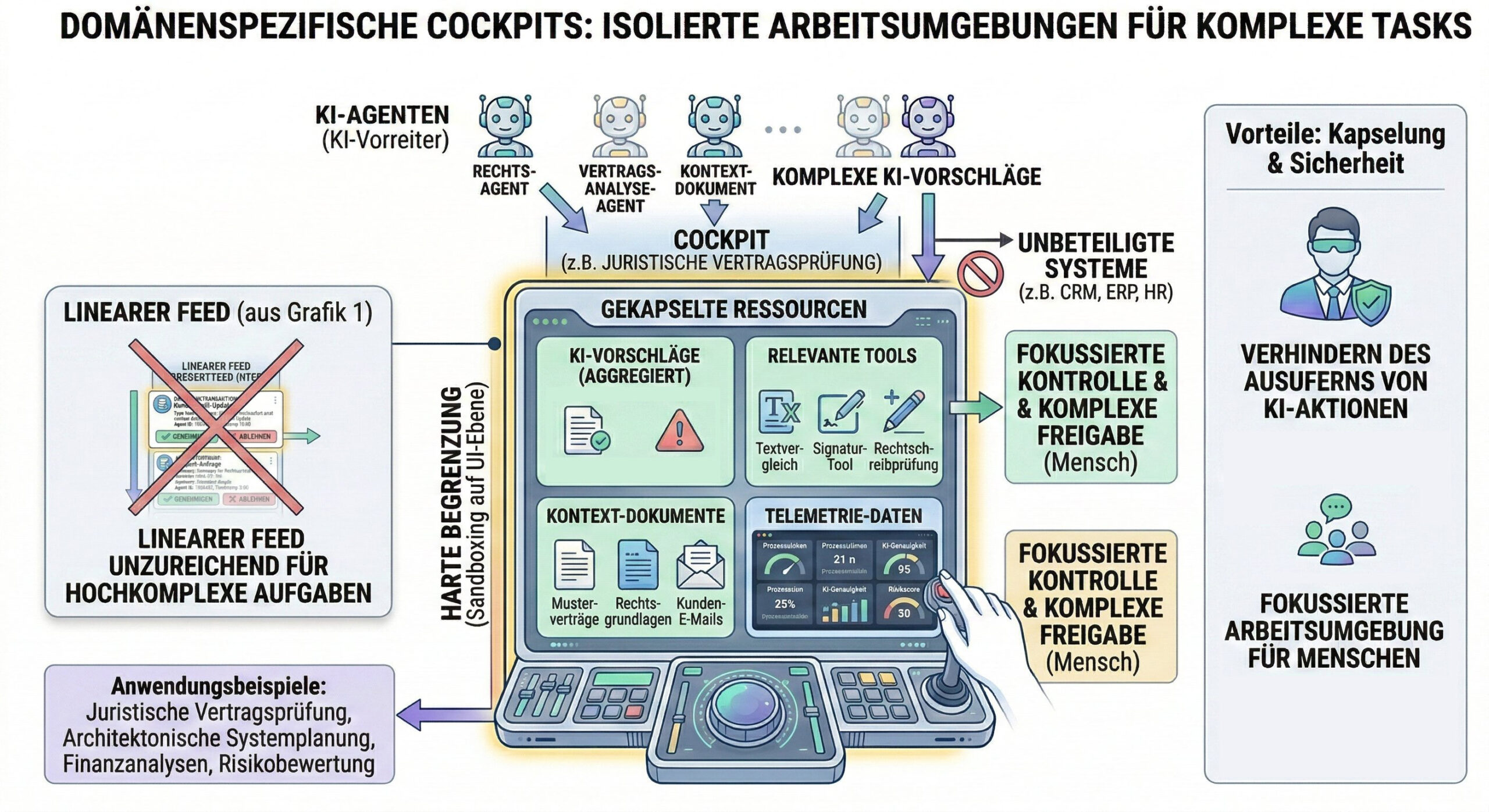

2. Domänenspezifische Cockpits Isolierte Arbeitsumgebungen für komplexe Tasks

Wenn Workflows eine hohe Komplexität erreichen – beispielsweise in der juristischen Vertragsprüfung oder der architektonischen Systemplanung –, ist ein linearer Feed unzureichend. Hier implementieren wir das Konzept der Cockpits. Ein Cockpit ist eine strikt isolierte Arbeitsumgebung, die präzise auf einen spezifischen Use-Case oder eine Abteilung zugeschnitten ist. Es aggregiert nicht nur die generierten Vorschläge der KI, sondern kapselt gleichzeitig alle relevanten Tools, Kontext-Dokumente und Telemetrie-Daten, die der Agent für diesen speziellen Bereich nutzen darf.

Cockpits fungieren somit nicht nur als Benutzeroberfläche, sondern sie liefern die fundamentale Struktur für das Gesamtsystem. Indem sie das Wirkungsfeld eines Agenten hart begrenzen (Sandboxing auf UI-Ebene), verhindern sie das Ausufern von KI-Aktionen in unbeteiligte Systeme und bieten dem Menschen eine fokussierte Kontrollstation für hochkomplexe Freigaben.

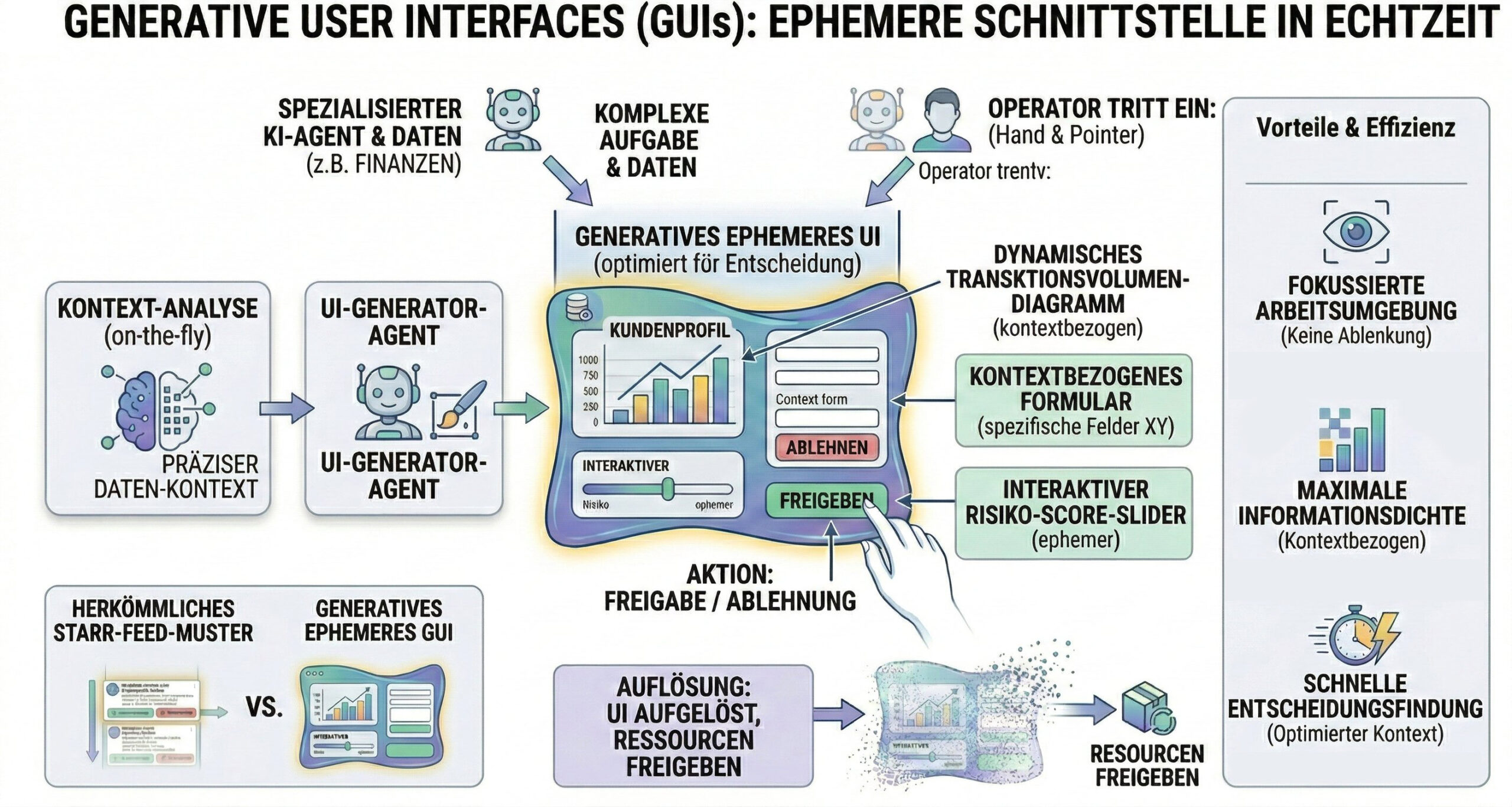

3. Generative User Interfaces (GUIs) Ephemere Schnittstellen in Echtzeit

Ein revolutionärer Ansatz, der die Grenzen klassischer Frontend-Entwicklung sprengt, ist das Konzept der Generative User Interfaces (Oftmals als UI-Streaming oder Micro-Frontends im LLM-Kontext bezeichnet). Anstatt den Nutzer auf starre Dashboards zu zwingen, analysiert das System den aktuellen Kontext und generiert on-the-fly exakt die Interface-Elemente (Diagramme, Formulare, interaktive Widgets), die für die anstehende Freigabeentscheidung optimal sind. Sobald die Aktion abgeschlossen ist, wird dieses ephemere Interface wieder verworfen. Diese dynamische Anpassung garantiert, dass der User niemals von irrelevanten UI-Elementen abgelenkt wird und die Informationsdichte pro Pixel maximiert wird.

Implementierungs-Fokus: Generative UIs erfordern eine strikte Trennung von Datenstruktur (JSON) und Repräsentation (React/Vue Components), sodass das LLM lediglich Parameter füllt und das System die UI-Komponenten deterministisch rendert. So wird Code-Injection verhindert.

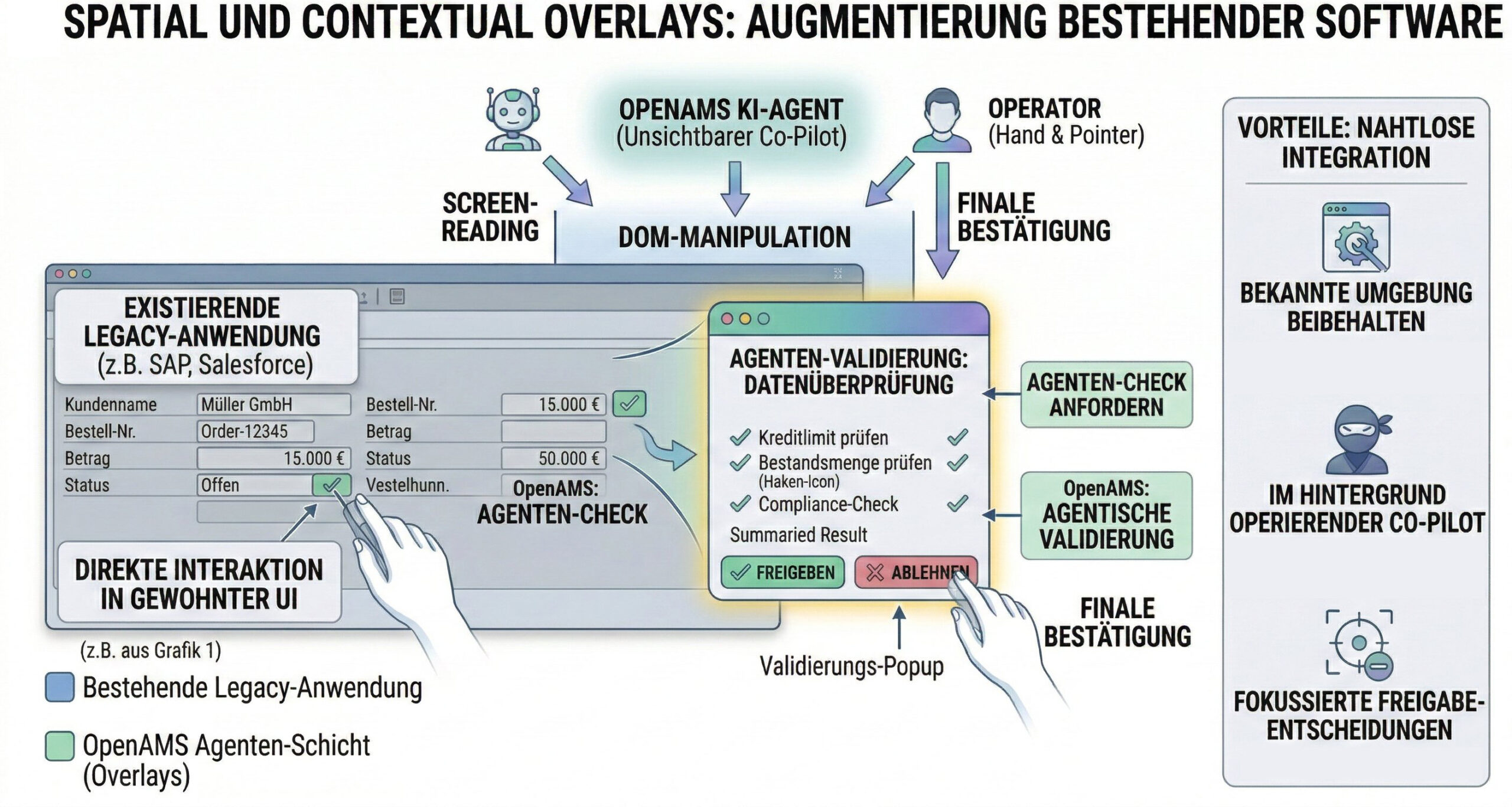

4. Spatial und Contextual Overlays Augmentierung bestehender Software

Nicht jeder Prozess lässt sich sinnvoll in ein neues, zentralisiertes System migrieren. Contextual Overlays projizieren die agentische Verifikationsschicht direkt über bestehende Legacy-Anwendungen (z.B. SAP, Salesforce). Durch Screen-Reading und DOM-Manipulation identifiziert der Agent laufende Prozesse und blendet kontextsensitive Freigabe-Buttons oder Validierungs-Popups nativ im Sichtfeld des Nutzers ein. Der Mensch interagiert somit weiterhin in seiner gewohnten Softwareumgebung, während die agentische KI im Hintergrund als unsichtbarer Co-Pilot operiert und über das Overlay lediglich finale Bestätigungen einholt.

Strukturelle Integrität durch Kapselung Das Cockpit als architektonischer Anker

Der strategische Fokus unseres Open-Source-Ansatzes liegt auf der Synthese dieser UI-Typologien. Während der Feed die Masse an Micro-Entscheidungen abfängt, fungieren die Cockpits als strukturelle Ankerpunkte. Sie verhindern die Fragmentierung der Arbeitsabläufe und stellen sicher, dass KI-Agenten immer nur im Kontext ihrer zugewiesenen Domäne agieren. Ohne diese strikte Kapselung droht die kognitive Überlastung der Administratoren und im schlimmsten Fall das unkontrollierte Vagabundieren von KI-Operationen quer durch die Unternehmens-IT.

Fazit: UI-Design ist Governance Zukunftssichere Interfaces für Autonomie

Die Art und Weise, wie wir mit agentischen Systemen interagieren, bestimmt maßgeblich deren Sicherheit und Effizienz. Ein System, das schlecht bedienbar ist, verleitet Administratoren dazu, Warnungen blind wegzuklicken (Alert Fatigue) – was die aufwendigsten Backend-Guardrails nutzlos macht. Die Entwicklung von Machine-to-Human-Interfaces, insbesondere durch die Kombination von asynchronen Feeds und isolierten Cockpits, ist daher kein reines Design-Feature, sondern ein essenzieller Bestandteil der IT-Sicherheitsarchitektur.

Wir evaluieren diese Interface-Konzepte kontinuierlich und integrieren die validierten Best-Practices direkt in unser Open-Source-Framework, um der Community sofort einsetzbare, sichere UI-Patterns an die Hand zu geben.

Diskutieren Sie mit uns über effiziente UI-Patterns für agentische Systeme und verfolgen Sie die Entwicklung unserer Cockpit-Architektur im dazugehörigen Open-Source-Repository.

Häufige Fragen zu Agentischen UIs Architektur und menschliche Interaktion

Der klassische Human-to-Machine-Ansatz (z.B. Chatbots) limitiert die KI auf die Geschwindigkeit menschlicher Eingaben und erfordert vom Nutzer ein permanentes Problembewusstsein. Im M2H-Paradigma agiert die KI autonom im Hintergrund und präsentiert lediglich hochverdichtete, entscheidungsreife Resultate. Dies ist der einzige Weg, um die asynchrone Verarbeitungsgeschwindigkeit von Agenten-Schwärmen für den Menschen nutzbar zu machen, ohne ihn kognitiv zu überfordern.

Die konsequente Anwendung ergonomischer, kontrollfokussierter UI-Konzepte transformiert KI-Agenten von einem experimentellen Risiko zu einem verlässlichen Produktivitäts-Multiplikator in Enterprise-Umgebungen.

Erkunden Sie die Implementierungsdetails unserer UI-Architektur im GitHub-Repository und gestalten Sie die Zukunft der Mensch-Maschine-Interaktion aktiv mit.

Kognitive Ergonomie in der Agentik Wissenschaftliche Basis der UI-Entwicklung

Die Gestaltung unserer Interfaces basiert fundiert auf der Cognitive Load Theory. Jeder überflüssige Klick, jeder unstrukturierte Datenpunkt und jeder Kontextwechsel bindet kognitive Ressourcen des Operators. Durch die strikte Trennung in hochfrequente Feeds und tiefgreifende Cockpits optimieren wir das Signal-Rausch-Verhältnis. Das System präsentiert nur jene Variablen, die für die finale Validierung essenziell sind.

Ein User-Interface für autonome Systeme ist nur exakt so effizient wie die katastrophalen Fehler, die es durch intelligentes Design zuverlässig verhindert.

Die zukünftige UI-Entwicklung wird sich nicht auf kosmetische Anpassungen beschränken, sondern auf die präzise mathematische Modellierung von Vertrauen, Wahrscheinlichkeiten und asynchronen Bestätigungs-Workflows konzentrieren.

Wissenschaftliche & Verifizierte Quellen:

[1] Nielsen Norman Group (2023): AI as a UI Paradigm – Shift from Command to Intent

[2] ArXiv Research (2023): Human-AI Interaction Patterns for Autonomous Agents

[3] Vercel Engineering (2024): Generative UI and Streaming Micro-Frontends for LLMs

[4] Journal of Neural Engineering (2021): Pragmatic Limits and Ethical Hurdles of Invasive BCIs

[5] Interaction Design Foundation: Cognitive Load Theory in Complex System Monitoring

[6] Microsoft Research (2019): Guidelines for Human-AI Interaction and Interface Design