Die Suche im Netz verändert sich gerade grundlegend. Statt nur eine Liste blauer Links zu liefern, beantworten Systeme wie ChatGPT Search, Gemini und Google AI Overviews Nutzerfragen immer häufiger direkt. Für Anwender ist das bequem. Für Unternehmen, Publisher, SEOs und Content-Verantwortliche bedeutet es jedoch eine neue Realität: Sichtbarkeit entsteht nicht mehr allein auf der klassischen Suchergebnisseite, sondern zunehmend in einer KI-vermittelten Antwortschicht.

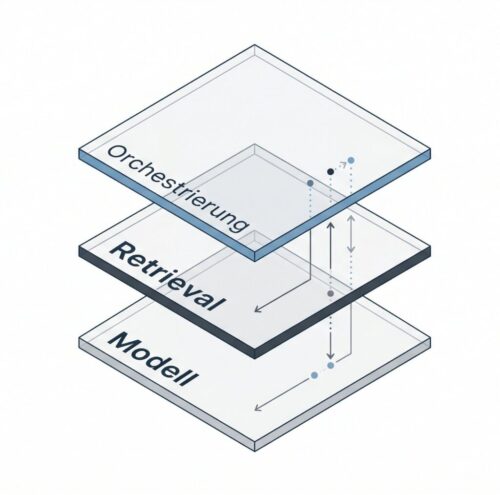

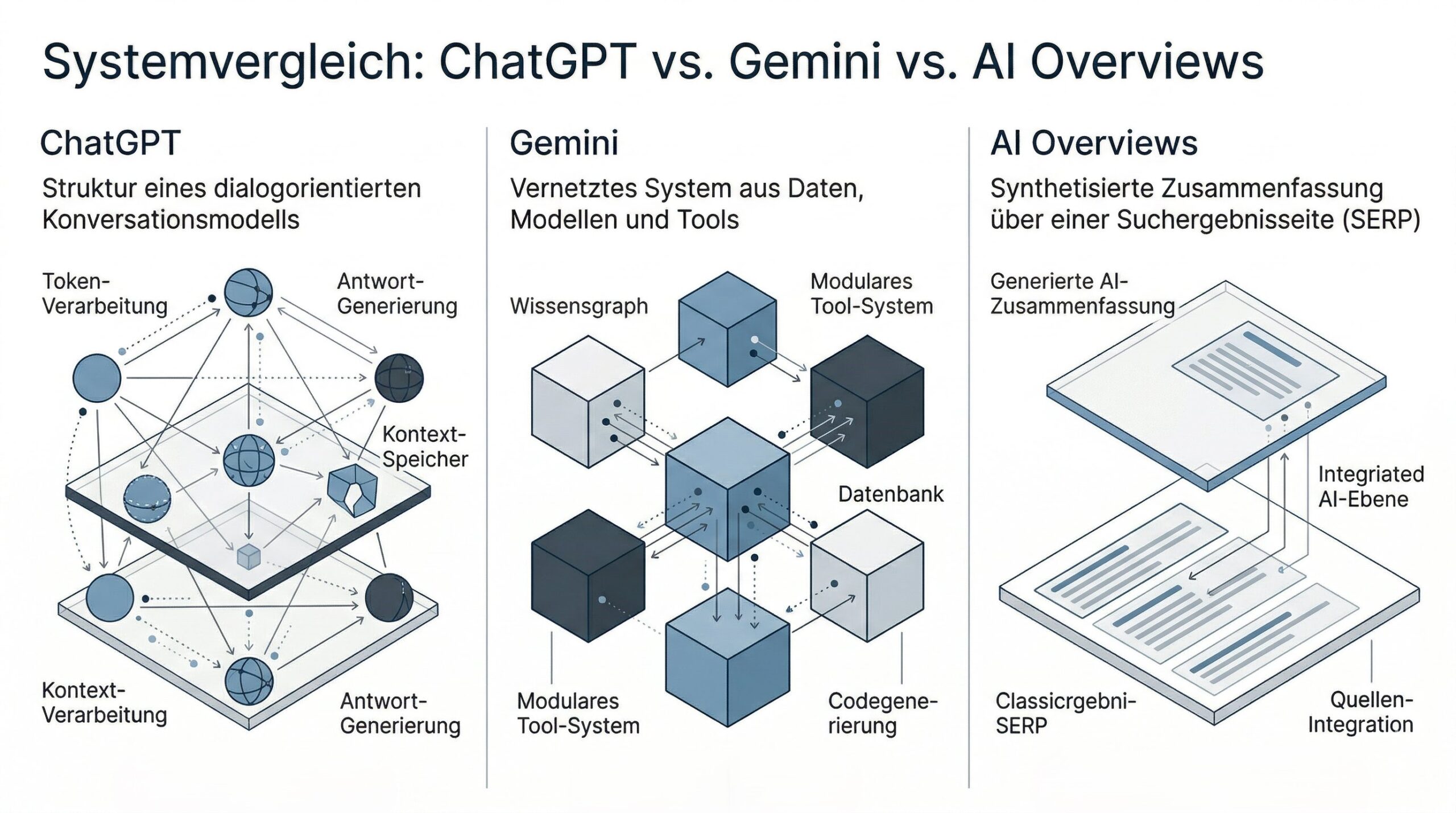

Wer verstehen will, wie diese Systeme arbeiten, muss drei Ebenen auseinanderhalten: Modell, Retrieval und Antwort-Orchestrierung. Das Sprachmodell erzeugt die Formulierung. Ein Retrieval- oder Suchsystem beschafft aktuelle Quellen. Eine Orchestrierungslogik entscheidet, wann gesucht wird, wie Ergebnisse priorisiert werden, wie Quellen kombiniert werden und welche Form die finale Antwort annimmt. Genau in dieser Kombination unterscheiden sich ChatGPT, Gemini und Google AI Overviews deutlich.

🔎 Für SEO ist das entscheidend: Ein gutes Ranking allein reicht künftig oft nicht mehr. Inhalte müssen zusätzlich so strukturiert, verständlich und vertrauenswürdig sein, dass KI-Systeme sie leicht extrahieren, richtig interpretieren und sinnvoll zitieren können. Das ist ein anderes Optimierungsziel als reine Keyword-Abdeckung.

In diesem Beitrag analysieren wir die technische Funktionsweise hinter den drei großen KI-Suchansätzen, erklären die Rolle von Retrieval, RAG, Query-Rewriting, Grounding und Ranking-Signalen, zeigen konkrete Unterschiede in der Ausgabe und leiten daraus eine belastbare Content-Strategie ab. Ergänzend finden Sie interne Vertiefungen zu SEO-Strategie, Content-Marketing und technischem SEO sowie externe Referenzen etwa zu OpenAI und Google Search Central.

Kurz gesagt: Alle drei Systeme nutzen KI, aber nicht auf dieselbe Weise. ChatGPT Search ist stark dialog- und syntheseorientiert, Gemini verbindet Modellfähigkeiten eng mit Google-Datenquellen und Tooling, während Google AI Overviews direkt in die Suchmaschine eingebettet sind und klassische Suchsignale mit generativer Verdichtung kombinieren. Genau diese Unterschiede entscheiden darüber, welcher Content in welchem System gewinnt.

⚡ Executive Summary

- ChatGPT Search kombiniert LLM-Antworten mit Websuche und Quellenverweisen, wenn aktuelle oder faktische Informationen benötigt werden.

- Gemini arbeitet stark mit Grounding und Tool-Nutzung, insbesondere über Google Search, Maps, Files und weitere Datenquellen.

- Google AI Overviews sind keine separate Suchmaschine, sondern eine generative Ebene innerhalb der Google-Suche, die Suchsignale, Entitäten, Indexdaten und Modellzusammenfassungen verbindet.

- Für SEO zählen heute stärker denn je E-E-A-T, semantische Klarheit, Quellentiefe, Aktualität, Zitierbarkeit und saubere Struktur.

- Wer in KI-Suchen sichtbar sein will, muss Inhalte für Menschen und Maschinen schreiben: präzise, belegbar, modular, aktuell und fachlich belastbar.

Das gemeinsame Grundprinzip: KI-Suche ist keine Magie, sondern eine Kette aus mehreren Systemen LLM, Retrieval, Ranking, Grounding und Ausgabeformat

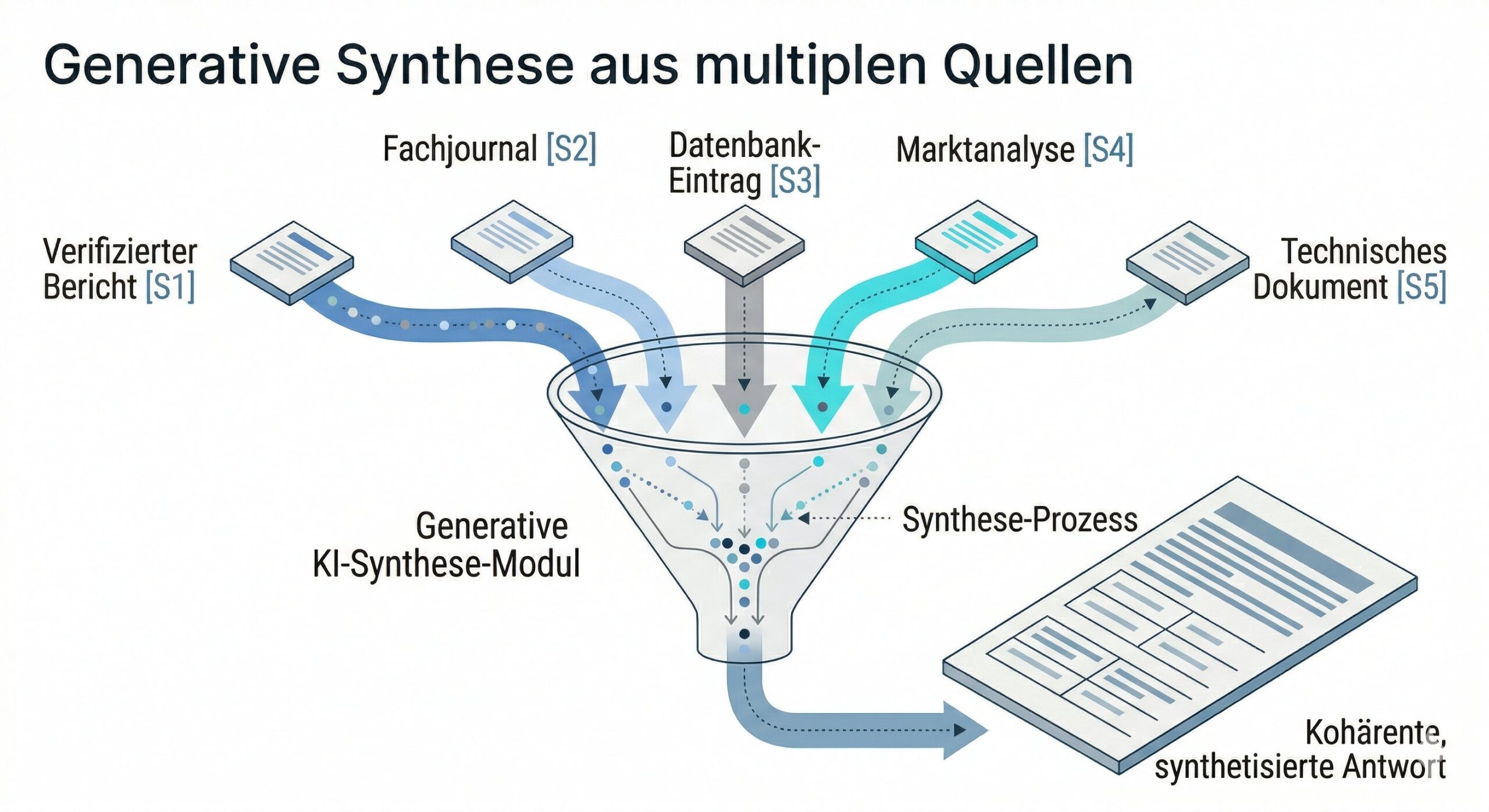

Ob ChatGPT, Gemini oder AI Overviews: Im Kern laufen fast immer ähnliche Prozessschritte ab. Der Nutzer stellt eine Frage in natürlicher Sprache. Das System interpretiert die Absicht, prüft, ob Weltwissen aus dem Modell genügt oder ob aktuelle Websignale gebraucht werden, startet bei Bedarf eine Suche, sammelt passende Quellen, verdichtet die Inhalte, formuliert eine Antwort und versieht diese oft mit Verweisen oder Folgefragen. Die Such-Experience wirkt dadurch gesprächiger, bleibt technisch aber ein Zusammenspiel aus Information Retrieval und generativer Synthese.

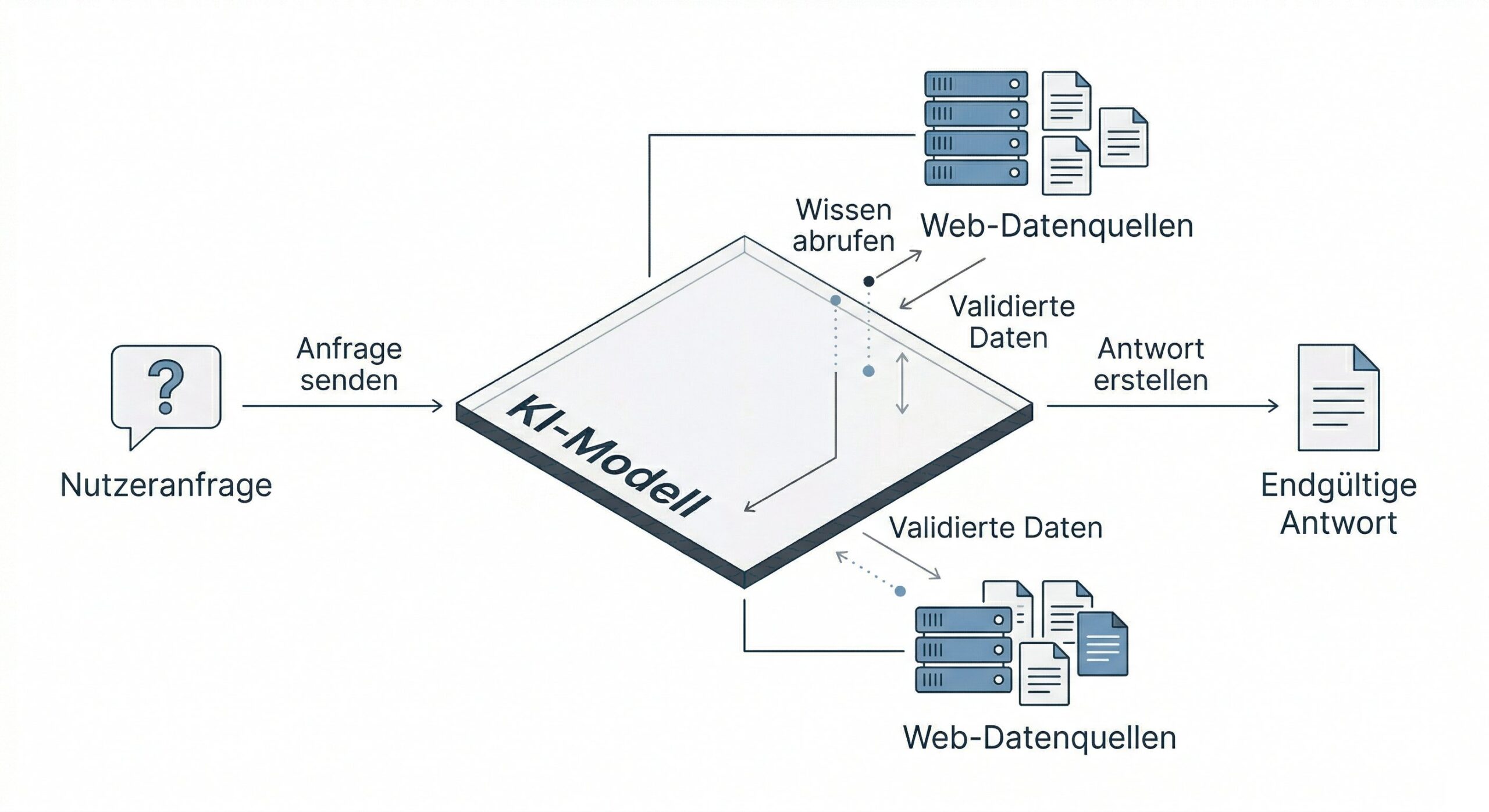

Ein wichtiger Begriff ist RAG, also Retrieval-Augmented Generation. Dabei antwortet das Modell nicht nur aus seinem Trainingswissen, sondern erhält zur Laufzeit zusätzliche Dokumente oder Webtreffer. Diese werden als Kontext in den Prompt oder in eine interne Tool-Pipeline eingespeist. Das reduziert Halluzinationen, erhöht Aktualität und ermöglicht Zitate. RAG ist jedoch kein Garant für Wahrheit. Wenn die gefundenen Quellen schwach sind, wird auch die Antwort schwach. Deswegen ist Quellenqualität in KI-Suchen so relevant.

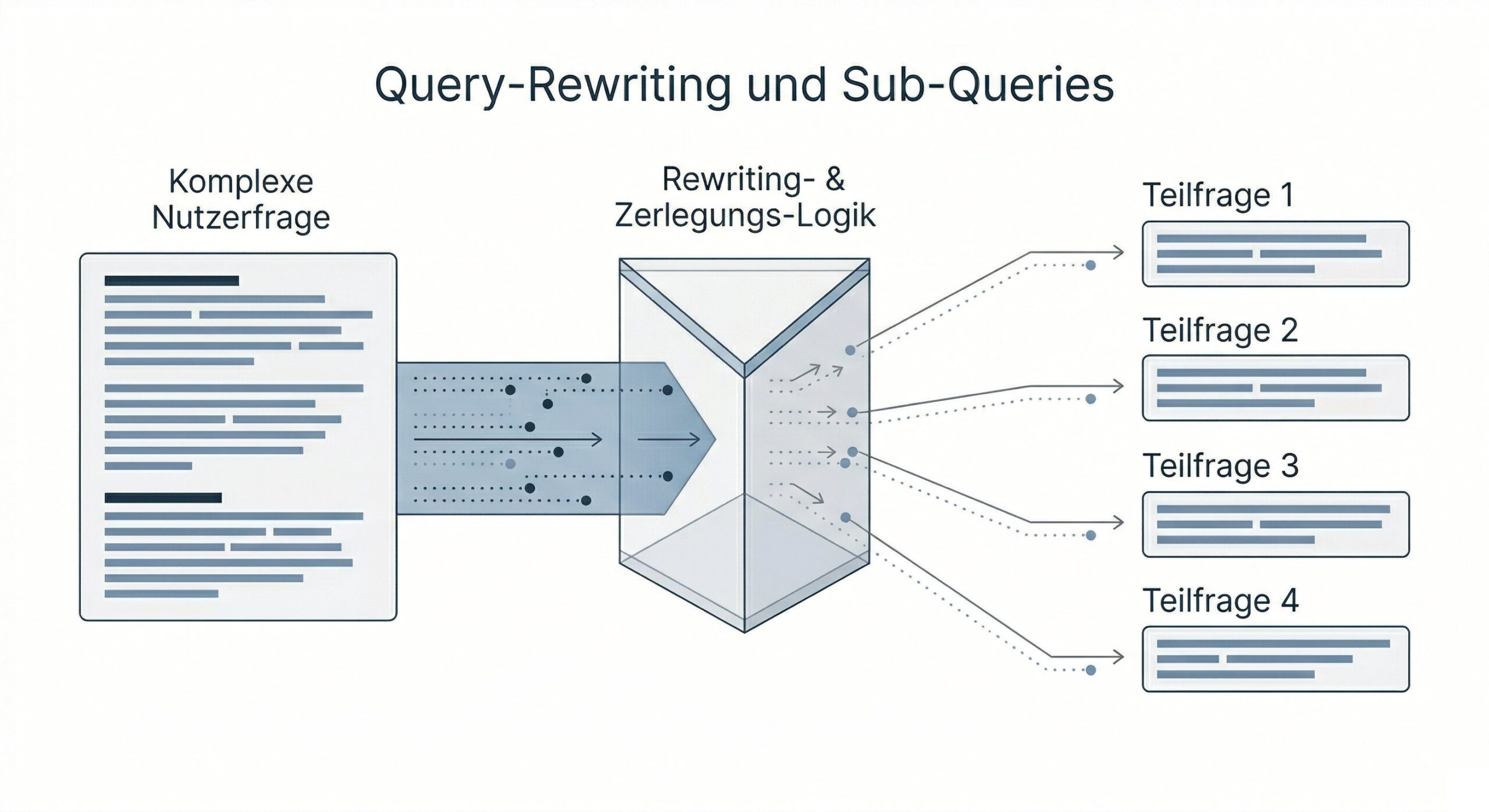

Ebenso zentral ist Query-Rewriting. Nutzer tippen selten perfekte Suchanfragen ein. Moderne KI-Suchen zerlegen daher eine Frage oft intern in Teilfragen. Aus „Wie funktionieren die KI-Suchen hinter ChatGPT, Gemini und Google AI Overviews?“ können intern beispielsweise Subqueries wie „ChatGPT Search official explanation”, „Gemini grounding search”, „AI Overviews Search Central” oder „differences generative search vs traditional search” entstehen. Dieser Zwischenschritt ist ein Grund dafür, warum dieselbe Nutzereingabe bei verschiedenen Systemen zu völlig unterschiedlichen Ergebnissen führen kann.

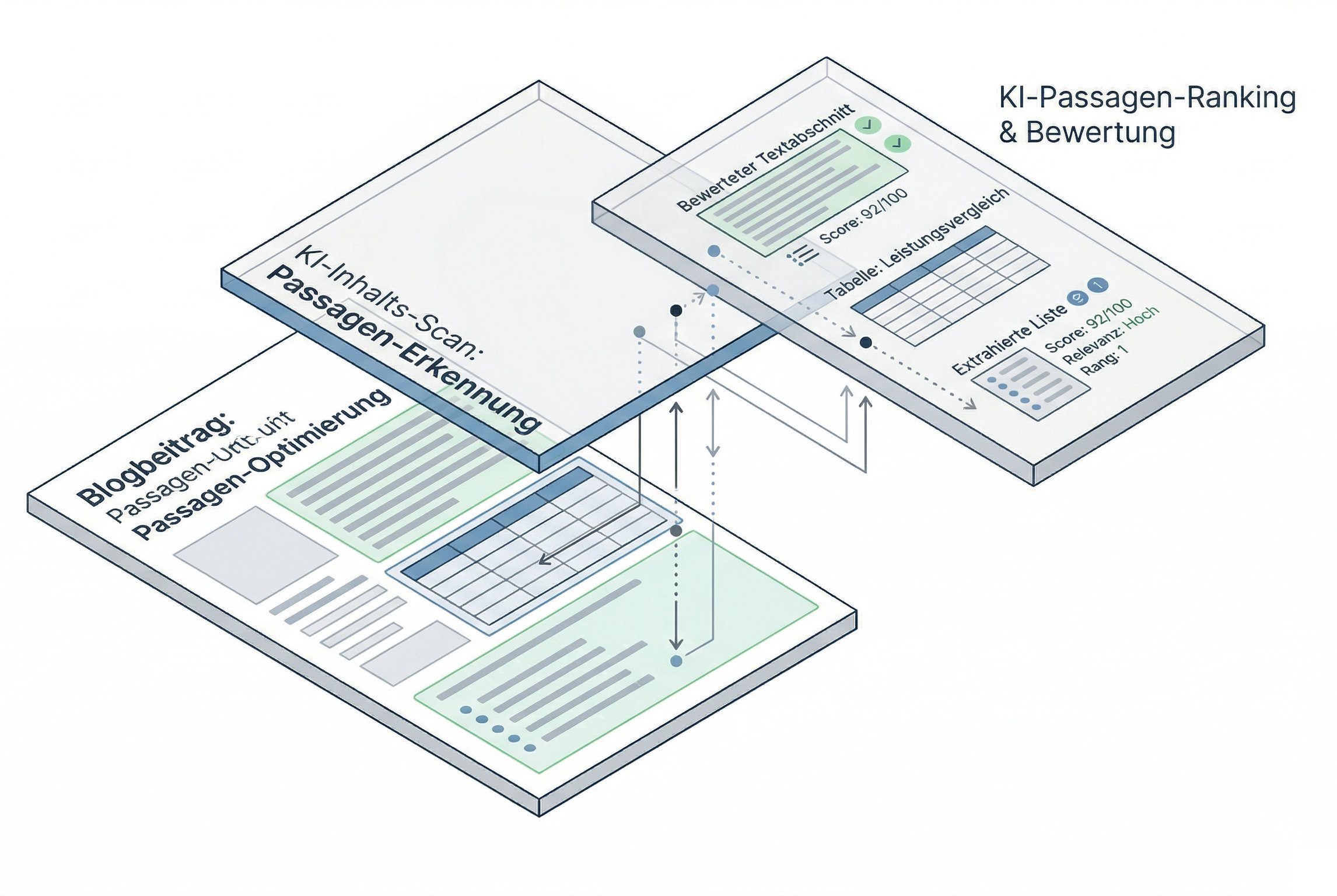

Ein weiterer Schritt ist Re-Ranking. Nicht nur die Suchmaschine entscheidet, welche Dokumente wichtig sind. Zusätzlich bewerten generative Systeme, welche Passagen für die konkrete Frage am nützlichsten sind. Ein Dokument kann in der klassischen SERP gut ranken, aber in der KI-Antwort kaum vorkommen, wenn die relevante Passage zu schwammig, zu werblich oder zu versteckt ist. Andersherum kann eine Unterseite mit einer exzellenten, präzisen Erklärung überraschend oft zitiert werden, obwohl sie in der klassischen Suche nicht auf Position 1 steht.

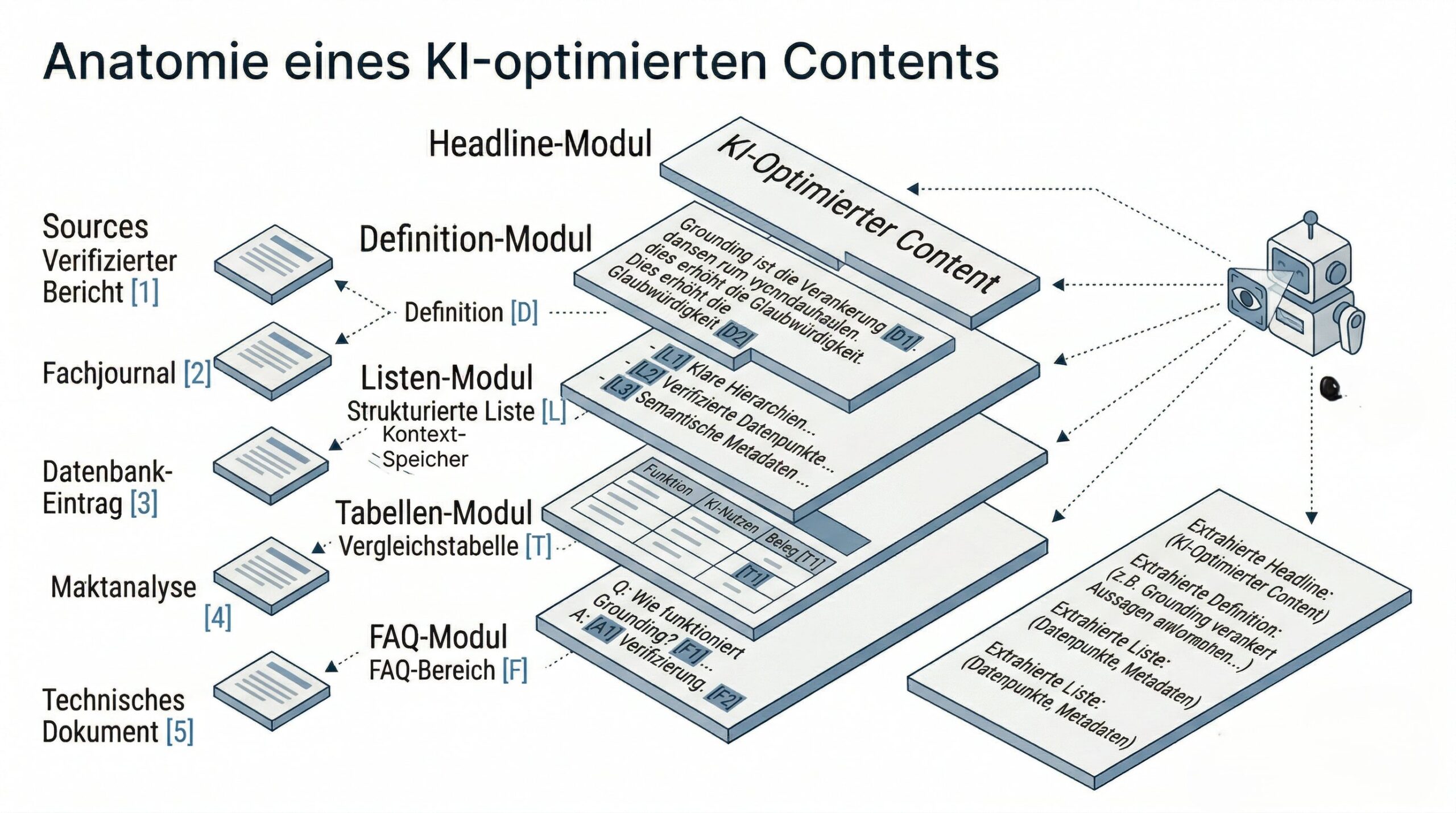

🧠 Das bedeutet für Content-Teams: Sichtbarkeit in der KI-Suche wird zunehmend passagenbasiert. Nicht nur die URL als Ganzes, sondern einzelne Abschnitte, Definitionen, Tabellen, FAQ-Antworten und Schritt-für-Schritt-Erklärungen werden zu SEO-Assets.

| Baustein | Funktion | Warum es für SEO wichtig ist |

|---|---|---|

| Intent-Erkennung | Versteht, ob Information, Vergleich, Kaufabsicht oder Navigation gemeint ist | Content muss Suchintention klar bedienen, sonst sinkt die Chance auf Einbindung |

| Query-Rewriting | Formt Nutzerfragen in präzisere Teilabfragen um | Semantisch starke Inhalte gewinnen, nicht nur exakte Keywords |

| Retrieval | Beschafft Dokumente, Treffer, Entitäten oder Datensätze | Technische Auffindbarkeit und saubere Informationsarchitektur werden wichtiger |

| Grounding | Verankert Aussagen in konkreten Quellen oder Tools | Belegbare Aussagen, Zahlen und Definitionen erhöhen Zitierbarkeit |

| Generative Synthese | Verdichtet mehrere Quellen in eine Antwort | Einzigartige Perspektiven und klare Formulierungen werden belohnt |

| Citations / Links | Zeigt Referenzen, weiterführende Quellen oder SERP-Elemente | Markenpräsenz und Klickchancen hängen von Vertrauenswürdigkeit und Relevanz ab |

Wie ChatGPT Search im Hintergrund arbeitet Dialogorientierte Suche mit Web-Anbindung und Quellenverweisen

ChatGPT Search ist aus Nutzersicht eine Mischung aus Chatbot und Suchmaschine. Das System beantwortet Fragen in natürlicher Sprache und greift bei Bedarf auf Websuche zurück. Besonders stark ist dieser Ansatz bei komplexen, offenen, vergleichenden oder mehrstufigen Anfragen. Während eine klassische Suchmaschine zehn Links präsentiert, versucht ChatGPT Search, die Anfrage direkt in eine strukturierte Antwort zu überführen – oft mit Quellen, Listen, Vergleichspunkten und Follow-up-Möglichkeiten.

Technisch lässt sich das als orchestrierte Tool-Nutzung beschreiben. Das Modell entscheidet zunächst, ob eine Webrecherche nötig ist. Ist das der Fall, werden Suchanfragen erzeugt, Treffer gesammelt und relevante Dokumentausschnitte extrahiert. Anschließend baut das Modell daraus eine Antwort, die nicht nur Fakten wiedergibt, sondern den Nutzerkontext berücksichtigt: Will jemand einen Überblick, einen Vergleich, eine Handlungsempfehlung oder eine Liste mit Prioritäten?

Ein entscheidender Unterschied zur klassischen Suche liegt in der Antwortkomposition. ChatGPT Search erstellt meist keine bloße Zusammenfassung eines einzelnen Dokuments, sondern eine synthetische Antwort über mehrere Quellen. Darin steckt zugleich Stärke und Risiko. Stärke, weil Nutzer schneller zu einer nutzbaren Antwort gelangen. Risiko, weil Quellen ungleich gewichtet werden können und Nuancen aus Originaltexten manchmal verkürzt erscheinen.

Für Publisher und Unternehmen ist besonders relevant, wie zitierfähig Inhalte in dieser Umgebung sind. ChatGPT Search bevorzugt tendenziell Inhalte, die klar gegliedert, explizit formuliert und in sich verständlich sind. Eine schwammige Einleitung ohne harte Aussagen ist schwerer extrahierbar als ein Abschnitt mit sauberer Definition, prägnanten Bulletpoints, konkreten Schritten oder klar benannten Vor- und Nachteilen.

Deshalb funktionieren in der KI-Suche häufig Formate wie:

- Definitionen („Was ist X?“)

- Vergleiche („X vs. Y“)

- How-to-Strukturen („So setzen Sie … um“)

- Checklisten und Fehlerlisten

- FAQ-Antworten mit direkter, eindeutiger Sprache

📌 Ein typischer Ablauf in ChatGPT Search sieht so aus: Die Frage wird interpretiert, in Subqueries zerlegt, das Web wird durchsucht, passende Quellen werden abgerufen, relevante Passagen werden gewichtet, danach wird eine verständliche Antwort in natürlicher Sprache erzeugt. Ist die Frage offen formuliert, ergänzt das System häufig eigene Struktur – etwa „So funktioniert es“, „Darauf sollten Sie achten“ oder „Die wichtigsten Unterschiede“.

Ein Praxisbeispiel: Fragt ein Nutzer nach „beste CRM-Software für kleine B2B-Teams in Deutschland“, reicht allgemeines Modellwissen nicht aus. ChatGPT Search muss aktuelle Informationen berücksichtigen, Funktionen vergleichen, idealerweise deutschsprachige Marktsignale einbeziehen und die Antwort nach Kriterien wie Preis, Integrationen, Datenschutz oder Bedienbarkeit strukturieren. Der Mehrwert entsteht also nicht nur durch Suche, sondern durch bewertende Synthese.

SEO-seitig bedeutet das: Content sollte nicht nur Informationen enthalten, sondern auch vergleichbar und entscheidungsfähig machen. Wer nur Marketingfloskeln publiziert, liefert dem System kaum brauchbares Material. Wer dagegen konkrete Kriterien, Alternativen, Limitierungen und Einsatzszenarien beschreibt, erhöht die Chance, in der Antwortlogik aufzutauchen.

💡 Experten-Insight zu ChatGPT Search

Viele Content-Teams optimieren noch für die alte SERP-Logik: Hauptkeyword in die H1, ein paar semantische Begriffe, dann viel Fließtext. Für ChatGPT Search reicht das nicht. Erfolgreich sind Inhalte, die komprimierte Erkenntniseinheiten liefern: kurze Definition, klare Kernaussage, geordnete Kriterien, nachvollziehbare Beispiele und ein Abschnitt mit Grenzen oder Risiken. Genau solche Textbausteine lassen sich maschinell gut extrahieren und synthetisieren.

Besonders stark performen häufig Seiten, die innerhalb eines Artikels sowohl Einsteigerfragen als auch Fortgeschrittenenaspekte beantworten. Das erhöht die Wahrscheinlichkeit, für unterschiedliche Query-Tiefen als Quelle in Frage zu kommen.

Wie Gemini sucht: Grounding, Tools und Google-Ökosystem Warum Gemini oft stärker kontext- und datenquellenbezogen arbeitet

Gemini ist nicht nur ein Chatbot, sondern eine Plattformlogik. In der Praxis zeigt sich das daran, dass Gemini Antworten mit verschiedenen Datenquellen und Tools verbinden kann. Zentral ist dabei der Begriff Grounding. Grounding bedeutet, dass die Modellantwort an eine externe Quelle, eine Suchabfrage, eine Datei, einen Kartendienst oder eine andere verifizierbare Datenquelle angebunden wird. Statt rein generativ zu reagieren, wird das Modell gewissermaßen „geerdet“.

Gerade bei Google ist das strategisch besonders stark, weil das Unternehmen über ein enormes Such-, Karten-, Entitäten- und Wissensökosystem verfügt. Gemini kann dadurch – je nach Oberfläche und Anwendungsfall – nicht nur generisch „im Web suchen“, sondern Antworten mit Suchergebnissen, lokalen Signalen, Dateien, Workspace-Kontext oder anderen Werkzeugen verbinden. Für Nutzer entsteht so oft der Eindruck, Gemini „wisse mehr“, tatsächlich liegt die Stärke aber häufig in der Verknüpfung des Modells mit relevanten Tools.

Ein wichtiger Unterschied zu ChatGPT Search ist der stärkere Tool-Fokus. Bei Gemini spielt nicht nur das Abrufen von Webseiten eine Rolle, sondern auch, welches Tool für welchen Fragetyp sinnvoll ist. Eine lokale Frage kann stärker von Maps-Signalen profitieren, eine Datenfrage von strukturierten Quellen, eine Recherchefrage von Suchergebnissen, eine Arbeitsfrage von verknüpften Dokumenten. In modernen KI-Systemen verschwimmen damit Suche, Assistenz und Agentenlogik.

Für SEO ist das hochspannend, weil sich die Sichtbarkeit nicht nur an HTML-Seiten entscheidet. Wer lokale Präsenz, strukturierte Daten, klar gepflegte Entitäten, aktuelle Unternehmensinformationen und ein konsistentes Markensignal über mehrere Plattformen hinweg pflegt, erhöht die Chance, in solchen Umgebungen als verlässliche Quelle aufzutauchen. Das gilt besonders für lokale Anbieter, Software-Plattformen, Wissensmarken und Publisher mit klarer thematischer Autorität.

Ein Fallbeispiel: Ein Nutzer fragt Gemini nach „besten familienfreundlichen Hotels am Gardasee mit Kinderpool und guter Lage für Ausflüge“. Klassische Suchergebnisse würden Hotels, Listenartikel, Booking-Portale und Kartenresultate ausspielen. Gemini kann hingegen Suchsignale, lokale Relevanz, Bewertungen, Entitäten, Kartenkontext und natürlichsprachige Kriterien zusammenführen. Für den Betreiber eines Hotels reicht es dann nicht, nur eine schöne Landingpage zu besitzen. Wichtiger werden saubere Standortdaten, klare Leistungsmerkmale, strukturierte Inhalte, konsistente Erwähnungen und inhaltlich präzise Formulierungen.

🔧 Aus Developer- und Plattformperspektive ist Gemini außerdem interessant, weil Tooling, function calling und Suchanbindung enger zusammenspielen. Das macht Gemini stark für produktive Workflows und kontextreiche Antworten. Für Publisher heißt das: Inhalte müssen nicht nur rankbar, sondern maschinenlesbar anschlussfähig sein.

Praktisch bedeutet das: klare Abschnittstitel, logisch getrennte Themenblöcke, direkte Antworten, strukturierte Tabellen, aktualisierte Zahlen und möglichst wenig unnötige Einbettungen, die wichtige Aussagen verstecken. Wer Informationen in langen, bildlastigen, inhaltsarmen Layouts ohne klaren Textkern vergräbt, verschenkt Potenzial.

| System | Primäre Stärke | Typische Schwäche | Content-Implikation |

|---|---|---|---|

| ChatGPT Search | Natürliche Synthese, gute Vergleichs- und Beratungsantworten | Kann Nuancen verkürzen, wenn Quellen unpräzise sind | Explizite Aussagen, starke FAQ- und Vergleichsformate |

| Gemini | Grounding, Tool-Nutzung, Verbindung mit Google-Datenräumen | Stark abhängig vom verfügbaren Kontext und Tool-Zugriff | Strukturierte, kontextfähige, entitätenstarke Inhalte gewinnen |

| Google AI Overviews | Direkte Integration in Google Search und klassische Ranking-Signale | Weniger dialogisch, stärker suchlogisch begrenzt | SERP-Stärke plus Zitierbarkeit und E-E-A-T sind zentral |

Was Google AI Overviews anders macht Generative Antworten direkt in der Suchmaschine statt als separater Chat

Google AI Overviews sind aus strategischer Sicht besonders relevant, weil sie nicht „neben“ der Suche existieren, sondern innerhalb der Google-Suche. Das ist mehr als ein UX-Detail. Es bedeutet, dass die generative Antwortschicht direkt auf klassische Suchmechanismen, Indexdaten, Ranking-Signale, Entitäten, Knowledge Graph-Aspekte und SERP-Features aufsetzt. AI Overviews sind daher keine komplette Ablösung der Suche, sondern eher eine verdichtende Schicht über dem bestehenden Suchsystem.

Diese Einbettung verändert die Spielregeln. Während ein Chatbot stärker dialogisch reagiert, orientiert sich Google AI Overviews näher an Suchabsicht, Query-Klassen, Ergebnisqualität und Sicherheitsschwellen. Google muss entscheiden, für welche Suchanfragen eine KI-Zusammenfassung sinnvoll und verantwortbar ist. Nicht jede Suchanfrage eignet sich gleich gut. Je sensibler, aktueller oder riskanter das Thema, desto stärker greifen Qualitäts- und Sicherheitsmechanismen.

Ein technischer Kernpunkt ist die Passagen- und Quellenverdichtung. Google identifiziert für eine Query relevante Informationen aus dem Index und kann diese in eine generative Übersicht überführen. Dabei spielt nicht nur die Existenz guter Inhalte eine Rolle, sondern auch, wie leicht ein System den relevanten Kern extrahieren kann. Eine Seite mit klaren Definitionen, expliziten Schritten und nachvollziehbaren Belegen hat hier Vorteile gegenüber schwammigem Brand-Content.

Für SEOs ist besonders wichtig: AI Overviews sind stark an die Logik der Google-Suche gebunden. Das heißt, klassische SEO-Grundlagen bleiben relevant – Crawlbarkeit, interne Verlinkung, thematische Autorität, technische Stabilität, klare Seitentypen und hochwertige Inhalte. Gleichzeitig steigt die Bedeutung von komprimierter Nützlichkeit: Seiten müssen nicht nur ranken, sondern auch als Quelle für eine KI-Zusammenfassung taugen.

Ein Beispiel aus dem Gesundheits- oder Finanzumfeld zeigt die Spannung. Wenn Nutzer nach sensiblen Themen suchen, kann Google nicht einfach die lauteste oder am besten geschriebene Quelle bevorzugen. Signale wie Vertrauen, Sicherheit, fachliche Glaubwürdigkeit und Quellenlage werden wichtiger. Genau deshalb ist E-E-A-T keine leere SEO-Formel. In KI-Suchen wird das Prinzip operativ: Inhalte mit erkennbarem Autor, sauberer Einordnung, transparenten Grenzen und belastbaren Quellen sind systemisch im Vorteil.

📈 Für Publisher bedeutet das zweierlei. Erstens: Wer bereits in der klassischen Google-Suche stark ist, startet mit einem Vorteil. Zweitens: Dieser Vorteil reicht allein nicht. Inhalte müssen so präzise aufbereitet sein, dass sie in einer generativen Antwortschicht korrekt zusammengefasst werden können. Je klarer und modularer der Text, desto besser.

AI Overviews verändern auch die Klickdynamik. Manche Fragen werden direkt beantwortet, ohne dass Nutzer noch viele Seiten öffnen. Das ist kein Grund zur Panik, aber ein Anlass zur strategischen Anpassung. Sichtbarkeit muss künftig stärker in Markenpräsenz, Quellenerwähnung, Nachfrageaufbau und Conversion-Design gedacht werden – nicht nur in Sitzungen aus organischem Traffic.

🚀 Fallbeispiel aus der Praxis

Zwei Software-Anbieter veröffentlichen einen Artikel zum Thema „KI-gestützte Wissensdatenbank“. Anbieter A schreibt 2.500 Wörter Marketingtext mit vielen Behauptungen, aber wenigen klaren Definitionen. Anbieter B strukturiert den Beitrag in Was ist es?, Wie funktioniert es?, Vorteile, Grenzen, Implementierung, FAQ und ergänzt eine Vergleichstabelle. In klassischen Rankings können beide konkurrieren. In KI-Suchen wird Anbieter B deutlich häufiger als Quelle genutzt, weil die Seite extrahierbar, vergleichbar und präzise ist.

Die Lehre: Nicht nur mehr Text, sondern besser verdichteter Text gewinnt.

Die wichtigsten Unterschiede zwischen ChatGPT, Gemini und AI Overviews Nicht jedes KI-System belohnt dieselbe Content-Art

Wer KI-Suche strategisch verstehen will, darf nicht von „der einen KI-Suche“ sprechen. Die Systeme ähneln sich oberflächlich, unterscheiden sich aber in wichtigen Punkten:

- Benutzeroberfläche: ChatGPT und Gemini sind stark dialogisch. AI Overviews sind SERP-integriert und dadurch stärker query- und suchlogisch geprägt.

- Quellen-Logik: ChatGPT Search arbeitet stark über Webrecherche und Antwortsynthese. Gemini verbindet Modell und Tooling. AI Overviews hängen eng an Googles Such- und Qualitätslogik.

- Ziel der Antwort: ChatGPT will oft besonders nützlich formulieren. Gemini oft kontextreich assistieren. AI Overviews wollen Suchanfragen effizient verdichten.

- SEO-Auswirkung: Bei ChatGPT gewinnen gut zitierbare Expertentexte, bei Gemini zusätzlich strukturierte und entitätenstarke Datenräume, bei AI Overviews klassisches SEO plus passagenstarke Klarheit.

Ein häufiger Denkfehler ist, nur auf Rankings zu schauen. In KI-Suchen gewinnt oft der Content, der die Antwortmaschine am besten füttert. Dazu gehören präzise Formulierungen, Zahlen mit Einordnung, definierte Begriffe, klare Abwägungen und eine saubere Trennung von Fakten, Meinung und Empfehlung.

Der zweite Denkfehler lautet: „KI-Antworten machen Websites überflüssig.“ Das ist zu kurz gedacht. Gute Websites liefern weiterhin den Rohstoff für hochwertige KI-Antworten. Außerdem verschiebt sich der Wert von Content: von reinem Traffic-Fang hin zu Autoritätsaufbau, Markenwiedererkennung, Erwähnungen in Antworten und Conversion nach der Recherche. Wer das versteht, baut heute Inhalte, die in beiden Welten funktionieren – in der klassischen Suche und in der KI-Synthese.

Der dritte Denkfehler: „Ein langer Text reicht.“ Länge hilft nur dann, wenn sie strukturell nützlich ist. Ein 4.000-Wörter-Artikel voller Wiederholungen ist in KI-Suchen oft schlechter verwertbar als ein 1.800-Wörter-Artikel mit brillanter Gliederung, sauberem Entitätenbezug, klaren Definitionen und konkreten Handlungsschritten. Quantität bleibt relevant, aber nur in Verbindung mit Informationsdichte.

✅ Genau deshalb funktionieren Inhalte mit Zwischenfazits, Tabellen, Checklisten, Gegenüberstellungen, FAQs und Fallbeispielen so gut. Sie helfen nicht nur Lesern, sondern auch Maschinen.

Was das konkret für SEO und Content-Strategie bedeutet Von Keyword-Optimierung zu Answer Engineering

Die wohl wichtigste Konsequenz lautet: SEO entwickelt sich von reiner Suchmaschinenoptimierung zu Answer Engineering. Gemeint ist die gezielte Gestaltung von Inhalten, damit sie in menschlichen wie maschinellen Antwortkontexten funktionieren. Dabei bleiben klassische Grundlagen unverzichtbar, aber sie werden um neue Anforderungen ergänzt.

1. Inhalte müssen schneller auf den Punkt kommen. KI-Systeme bevorzugen oft Passagen, die eine Frage direkt beantworten. Lange Intro-Blöcke, die erst nach 400 Wörtern Substanz liefern, verlieren an Wert. Gute Inhalte arbeiten mit einer sofort verständlichen Kernaussage und bauen danach Tiefe auf.

2. Struktur wird zum Rankinghebel. Zwischenüberschriften, präzise Listen, FAQ-Elemente, Vergleichstabellen und sauber getrennte Absätze erleichtern sowohl das menschliche Scannen als auch die maschinelle Extraktion. Wer Informationen modular strukturiert, erhöht die Chance, als Quelle in einem KI-Kontext zu erscheinen.

3. Originalität und Erfahrung zählen stärker. Generische Zusammenfassungen ohne eigene Perspektive werden durch KI selbst leicht reproduzierbar. Was schwer kopierbar bleibt, sind echte Erfahrungen, Benchmarks, Prozesse, Fallbeispiele, interne Daten, Experteneinschätzungen und klare methodische Einordnungen. Das ist der neue Content-Moat.

4. Markenbildung gewinnt an Gewicht. Wenn Nutzer Antworten direkt im Interface erhalten, bleibt weniger Raum für zufällige Klicks. Umso wichtiger wird, dass eine Marke in Antworten genannt, wiedererkannt und als vertrauenswürdig abgespeichert wird. Inhalte sollten deshalb nicht anonym wirken, sondern ein erkennbares fachliches Profil transportieren.

5. Entitäten und Konsistenz werden wichtiger. Unternehmen, Personen, Produkte und Themen sollten über Website, Profile, strukturierte Daten, Erwähnungen und Inhalte konsistent beschrieben werden. Maschinen arbeiten stark entitätenorientiert. Inkonsistenz schwächt Vertrauen und Zuordnung.

6. Aktualität muss sichtbar sein. Gerade bei dynamischen Themen ist nicht nur wichtig, dass Inhalte aktualisiert wurden – die Aktualisierung muss im Content nachvollziehbar sein. Veraltete Screenshots, alte Zahlen oder widersprüchliche Aussagen reduzieren die Chance auf Nutzung in KI-Antworten.

7. Informationshierarchie ist entscheidend. Der wichtigste Satz, die stärkste Definition und die zentrale Unterscheidung sollten nicht tief im Text versteckt sein. Gute Autoren bauen die Hierarchie bewusst: erst Aussage, dann Erklärung, dann Beispiel, dann Einordnung.

Ein sehr wirksames Muster für moderne SEO-Texte ist daher: direkte Antwort + Vertiefung + Vergleich + Beispiel + FAQ + interne Verlinkung. Genau diese Struktur eignet sich hervorragend für Leser, klassische Suchmaschinen und generative Systeme zugleich.

Weitere vertiefende Strategien finden Sie in unseren Guides zu SEO-Audits, Topical Authority und WordPress mit Themify.

🧩 Konkrete Content-Checkliste für KI-Suchen

- Beantwortet der Artikel die Kernfrage innerhalb der ersten 120 Wörter?

- Gibt es klare Zwischenüberschriften mit eigenständigem Aussagewert?

- Sind Definitionen, Vergleiche und Handlungsschritte explizit formuliert?

- Gibt es mindestens ein eigenes Beispiel oder eine originäre Perspektive?

- Sind Zahlen, Aussagen und Empfehlungen transparent eingeordnet?

- Werden passende interne Links gesetzt, damit Themencluster erkennbar werden?

- Ist der Content auch ohne Videos, Slider oder versteckte Tabs verständlich?

- Existieren FAQ-Blöcke für häufige Folgefragen?

- Gibt es Tabellen oder Listen, die Auswahl- und Entscheidungsprozesse unterstützen?

- Ist klar, wer den Inhalt verantwortet und welche Expertise vorliegt?

Typische Fehler, durch die Content in KI-Suchen verliert Warum viele gute Websites trotzdem kaum erwähnt werden

Viele Unternehmen produzieren durchaus hochwertige Inhalte und werden trotzdem selten in KI-Antworten sichtbar. Das liegt oft nicht am Thema, sondern an der Präsentationsform. Die häufigsten Fehler sind überraschend banal:

- Zu viel Einleitung, zu wenig Antwort: Der Text kreist um das Thema, beantwortet die eigentliche Frage aber erst sehr spät.

- Viel Branding, wenig Substanz: Werblich formulierte Absätze ohne harte Aussagen sind schwer extrahierbar.

- Unklare Begriffe: Fachwörter werden genutzt, aber nicht definiert. Für Maschinen ist das problematisch, für Leser ebenfalls.

- Keine Entscheidungshilfe: Es fehlt an Kriterien, Gegenüberstellungen, Vor- und Nachteilen oder Einsatzszenarien.

- Fehlende Aktualität: Alte Screenshots, veraltete Preisangaben, veraltete Produktnamen oder widersprüchliche Aussagen schwächen Vertrauen.

- Zu viele Layout-Hürden: Akkordeons, Tabs, Slider, Overlays oder interaktive Widgets dürfen nützlich sein, aber der zentrale Textkern sollte immer direkt lesbar bleiben.

- Keine semantische Tiefe: Ein Beitrag beantwortet nur die Hauptfrage, aber nicht die typischen Folgefragen. Dadurch wirkt er aus KI-Sicht oberflächlich.

Ein weiterer Fehler ist das blinde Optimieren auf ein einzelnes Keyword. KI-Systeme arbeiten viel stärker über Bedeutung, Absicht, Entitäten und Antwortnutzen. Ein Beitrag, der nur eine Keyword-Phrase wiederholt, aber die eigentliche Nutzerfrage nicht umfassend löst, verliert mittelfristig an Relevanz.

⚠️ Besonders kritisch wird es bei sogenannten „Thin Expert Articles“. Das sind Texte, die nach außen fachlich wirken, intern aber nur bekannte Aussagen paraphrasieren. In einer Welt generativer Suche ist genau dieser Content-Typ am stärksten gefährdet, weil er leicht ersetzbar ist. Der bessere Weg ist, nachvollziehbare Tiefe einzubauen: Prozesse, Benchmarks, Fehlannahmen, konkrete Erfahrungen, reale Trade-offs.

Die Zukunft gehört daher nicht dem lautesten, sondern dem brauchbarsten Content.

Strategische Handlungsempfehlung: So erstellen Sie Content, der in klassischen und KI-Suchen gewinnt Ein umsetzbarer Framework für Redaktion, SEO und Web-Teams

Wenn Sie für ChatGPT Search, Gemini und Google AI Overviews optimieren wollen, brauchen Sie kein komplett neues SEO. Sie brauchen ein besseres SEO. Die wirksamste Vorgehensweise lässt sich in sieben Schritten zusammenfassen:

- Query-Mapping erstellen: Sammeln Sie nicht nur Hauptkeywords, sondern echte Nutzerfragen, Einwände, Vergleichsanlässe und Kaufkriterien.

- Antwortarchitektur definieren: Legen Sie fest, welche Kernfrage zuerst beantwortet wird und welche Folgefragen logisch anschließen.

- Content modular schreiben: Jeder Abschnitt sollte als eigenständige Erkenntniseinheit funktionieren.

- Originalität ergänzen: Fügen Sie Beispiele, Daten, Prozesse oder Erfahrungswerte ein, die nicht überall stehen.

- Belegbarkeit erhöhen: Verweisen Sie auf belastbare externe Quellen, wo es sinnvoll ist, etwa auf OpenAI, den Help Center Artikel zu ChatGPT Search oder Googles Informationen zu AI Overviews.

- Interne Cluster bauen: Verlinken Sie vertiefende Unterseiten, Glossare, Use Cases und Tutorials sinnvoll miteinander.

- Content pflegen: Überarbeiten Sie bestehende Rankings systematisch, statt nur neue Beiträge zu produzieren.

Für WordPress-Teams mit Themify Builder ist das besonders gut umsetzbar, weil sich Inhalte modular aufbauen lassen. Nutzen Sie fancy-heading für semantisch klare Abschnittswechsel, text-Module für direkte Antworten, box-Module für Insights und accordion für FAQs. So entsteht nicht nur eine saubere Leserführung, sondern auch eine maschinenfreundliche Informationsstruktur.

Ein zusätzlicher Hebel ist die redaktionelle Konsistenz. Wenn Ihre Website denselben Begriff mal als „KI-Suche“, mal als „AI Search“, mal als „generative Suche“ und mal völlig unscharf bezeichnet, erschweren Sie die semantische Zuordnung. Definieren Sie lieber einen klaren Kernbegriff, verwenden Sie Synonyme bewusst und erklären Sie Unterschiede transparent.

🏁 Das Ziel ist nicht, eine Maschine zu „hacken“. Das Ziel ist, den besten, klarsten und belastbarsten Antwortrohstoff für reale Nutzerfragen zu liefern. Wer das schafft, gewinnt in klassischen Rankings, in KI-Antworten und in der Wahrnehmung der Marke.

Fazit: ChatGPT Search, Gemini und Google AI Overviews beruhen alle auf dem Zusammenspiel von Suche und generativer KI, aber sie priorisieren unterschiedliche Mechanismen. ChatGPT glänzt in der dialogischen Synthese, Gemini in der kontext- und toolgestützten Grounding-Logik, Google AI Overviews in der Suchintegration. Für SEO bedeutet das eine klare Richtung: Bauen Sie Inhalte, die nicht nur ranken, sondern verständlich extrahiert, zuverlässig eingeordnet und sinnvoll zitiert werden können. Genau darin liegt der Wettbewerbsvorteil der nächsten Jahre.

Häufige Fragen zu KI-Suchen, ChatGPT, Gemini und Google AI Overviews FAQ für Leser, Entscheider, SEOs und Publisher

Nicht ganz. Alle drei Systeme nutzen KI, aber die Architektur unterscheidet sich. ChatGPT Search ist stark dialogisch und erzeugt aus Suchtreffern eine zusammenhängende Antwort. Gemini arbeitet zusätzlich stark mit Grounding und Tools, also mit der Verknüpfung des Modells zu Google Search, Maps, Dateien oder anderen Datenquellen. Google AI Overviews sind dagegen in die Google-Suche integriert und funktionieren als generative Verdichtung innerhalb der SERP. Für SEO ist dieser Unterschied zentral, weil nicht dieselben Content-Signale überall gleich stark wirken.