Ein GEO-Check wirkt von außen erstaunlich simpel. Man könnte meinen: ein paar Prompts formulieren, ChatGPT, Gemini, Claude, Perplexity und vielleicht noch Google AI Overviews abfragen, danach die Antworten nebeneinanderlegen und fertig ist die Analyse. Genau so einfach ist es aber nicht. Und genau an diesem Punkt beginnt der Unterschied zwischen einem oberflächlichen KI-SEO-Experiment und einem professionellen Prüfverfahren.

In der klassischen SEO war die Logik vergleichsweise klar. Man hatte Google, vielleicht noch Bing, definierte Keywords, prüfbare Rankings und ein halbwegs stabiles Verhältnis zwischen Optimierung und sichtbarem Resultat. In der generativen Suche verschiebt sich dieses Spiel vollständig. Es gibt nicht mehr nur die Suchergebnisseite, die man mit einem Ranking-Tracker sauber nachbauen kann. Stattdessen erzeugen Systeme eine eigene Antwort. Diese Antwort ist das Produkt aus Suchindex, Modellbewertung, Kontext, Nutzerzustand, Oberflächenlogik, Lokalisierung und teils auch aus Quellen, die über das jeweilige Interface anders gewichtet werden als über eine API.

Wie laufen GEO-Check & LLMO-Audit eigentlich konkret ab? Warum das in der Praxis viel aufwendiger ist als ein paar API-Abfragen

Unser erster Impuls bei der Entwicklung eines GEO-Checks beziehungsweise eines LLMO-Prüfverfahrens war daher derselbe, den viele Teams zunächst haben: Warum nicht einfach alle wichtigen APIs an ein Tool hängen und automatisiert fragen? Also zum Beispiel: „Was hältst du von Unternehmen X?“, „Welche Anbieter für Leistung Y sind in Region Z die besten?“ oder „Nenne drei empfehlenswerte Dienstleister in Mainz, Frankfurt oder Wiesbaden.“ Theoretisch klingt das vernünftig. Praktisch stößt man damit sehr schnell an eine harte Grenze: Die API-Antworten sind nicht deckungsgleich mit den Antworten, die reale Nutzer in App und Webinterface sehen.

Genau deshalb ist ein echter GEO-Check keine Spielerei, sondern eine methodische Replikation realer Nutzung. Wer das Grundverständnis dazu vertiefen möchte, findet ergänzend in unseren Beiträgen Wie funktioniert KI-SEO/GEO in 2026?, So funktionieren die KI-Suchen hinter ChatGPT, Gemini und Google AI-Overviews und Über die Relevanz von klassischen Webpräsenzen im KI-Zeitalter die passende gedankliche Vorarbeit.

Die eigentliche Frage lautet nicht: „Was sagt ein Modell theoretisch per API?“

Sondern: „Was sieht ein echter Nutzer in einer konkreten Nutzungssituation – aus einer bestimmten Region, mit einem bestimmten Interface, mit oder ohne Login und innerhalb einer bestimmten Suchintention?“

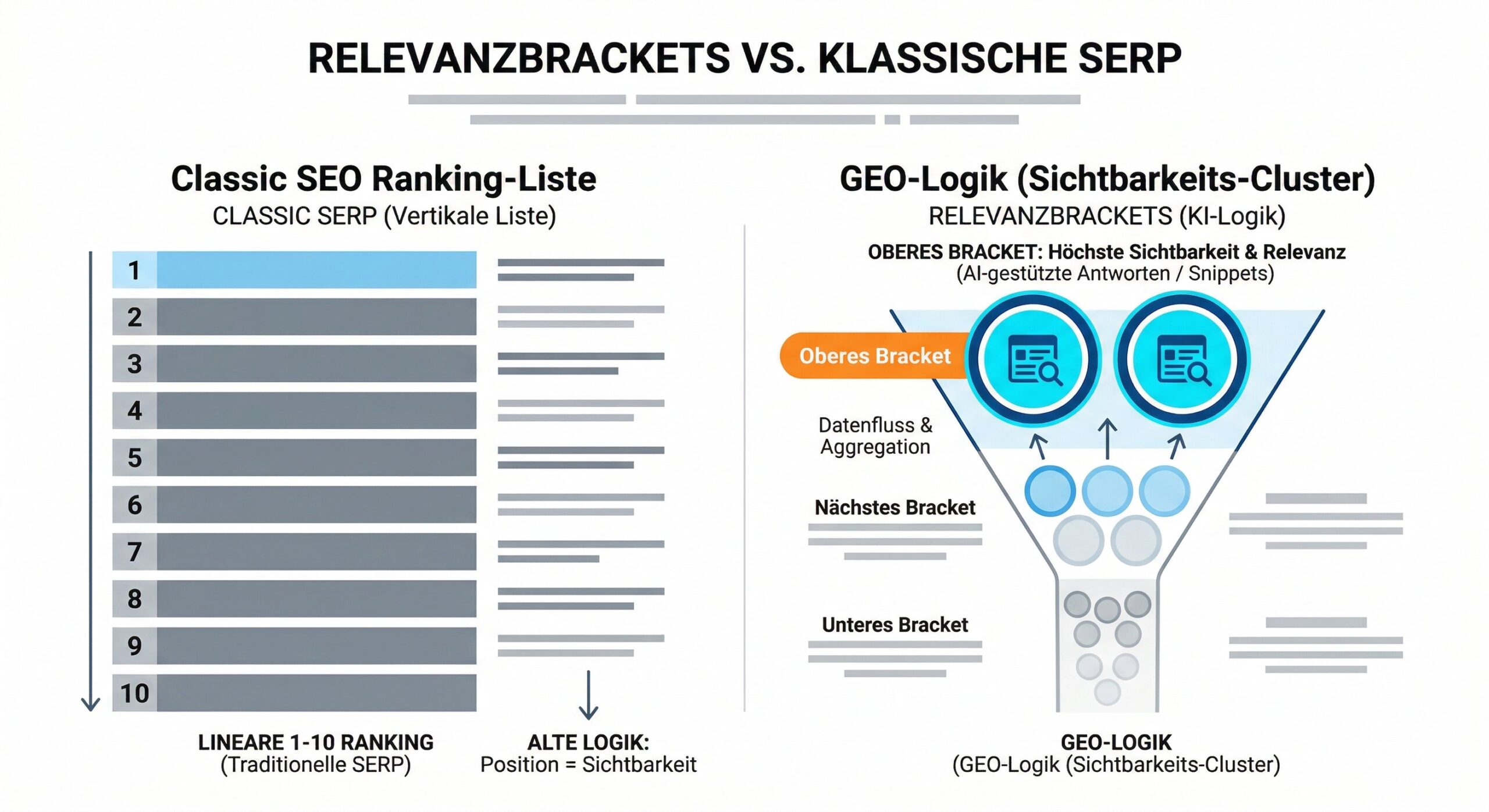

Wenn man das verstanden hat, wird auch klar, warum wir zwischen einem Check und einem Audit unterscheiden. Ein Check ist eine erste, verdichtete Lageeinschätzung: Wo taucht ein Unternehmen ungefähr auf, in welchem Themenumfeld, in welchem Relevanzbracket und gegen welche Wettbewerber? Ein Audit geht deutlich tiefer. Dort wird nicht nur geschaut, wo man steht, sondern warum man dort steht, welche Signale fehlen, welche Widersprüche im Systembild existieren und welche Maßnahmen die höchste Wahrscheinlichkeit haben, die Zitations- und Empfehlungsfähigkeit einer Marke tatsächlich zu steigern.

Worum es in der Praxis wirklich geht

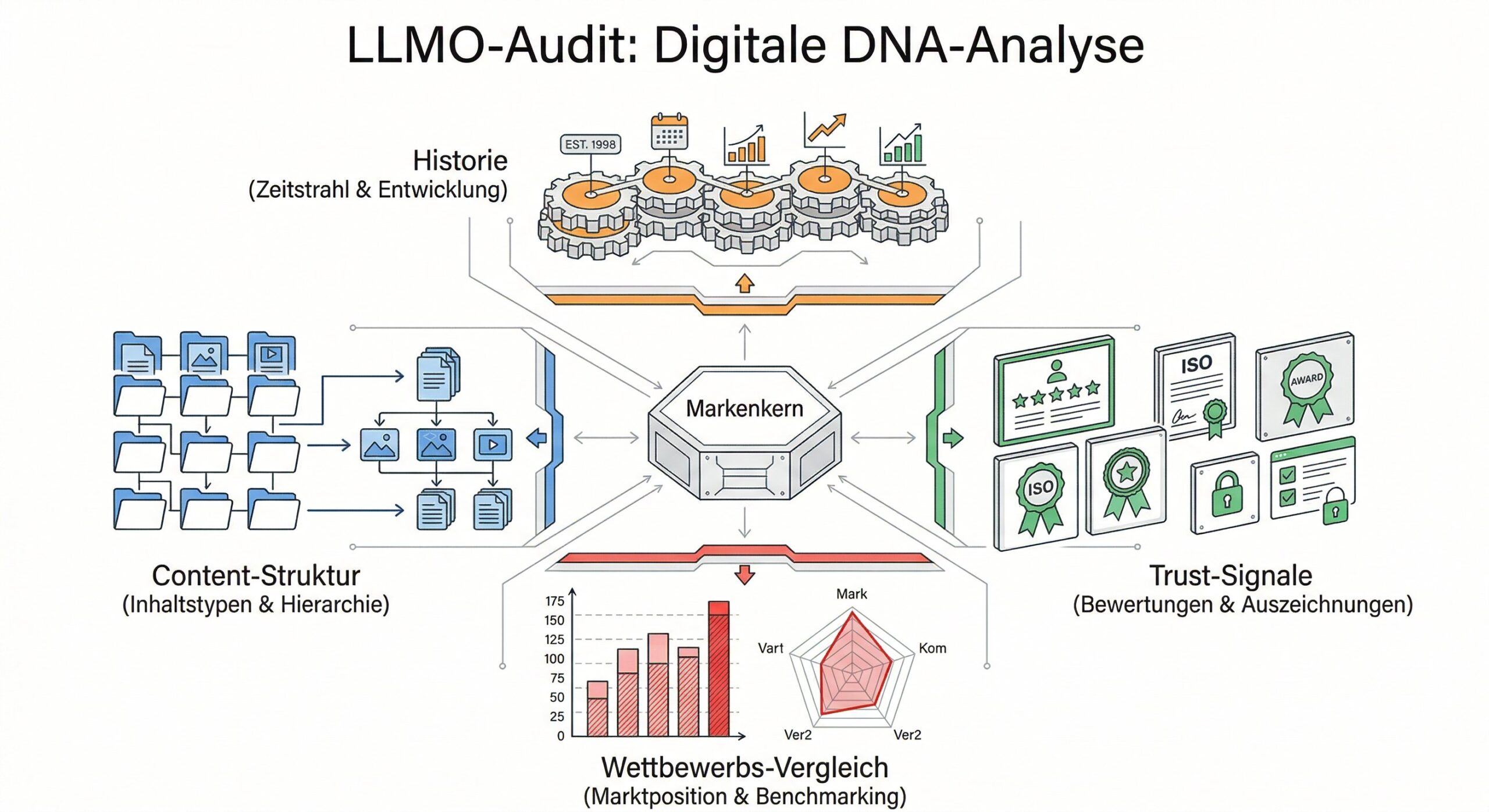

Ein professioneller GEO-Check misst nicht „irgendwas mit KI“, sondern versucht, die Wahrnehmungsrealität des Nutzers so nah wie möglich nachzubauen. Ein großes LLMO-Audit zerlegt darüber hinaus die gesamte digitale DNA eines Unternehmens: Marke, Historie, Signale, Wettbewerb, Content-Struktur, Zitatfähigkeit, Vertrauensmarker und Konversionsfähigkeit.

🧭 Check = Orientierung.

🧪 Audit = Tiefendiagnose mit Maßnahmenplan.

Was ein GEO-Check leistet

Ein Check ist eine saubere Oberflächenanalyse. Er zeigt, in welchem Themenfeld eine Marke aktuell auftaucht, wer in den oberen Relevanzbrackets genannt wird und welche Muster sich über mehrere Systeme hinweg bereits erkennen lassen.

- realitätsnahe Abfragen statt bloßer API-Logik

- Vergleich mehrerer KI-Oberflächen

- erste Bewertung von Sichtbarkeit und Trust

- klare Hypothesen für die nächsten Schritte

Was ein großes LLMO-Audit zusätzlich leistet

Ein Audit schaut hinter die Oberfläche. Es prüft nicht nur die Frage, ob eine Marke genannt wird, sondern analysiert ihre gesamte maschinelle Lesbarkeit und Vertrauensfähigkeit – inklusive Historie, Wettbewerb, Content-Dichte, Quellenlage und Wachstumsbarrieren.

- Historienanalyse über mehrere Jahre

- Wettbewerbskarte und Relevanzvergleich

- Bewertung von schwachen und starken Signalen

- präziser Maßnahmenplan nach Priorität

Wie ein realistischer Prüfpfad aussieht

Warum API-Abfragen allein in die Irre führen Die Differenz zwischen Modellzugang und echter Nutzeroberfläche

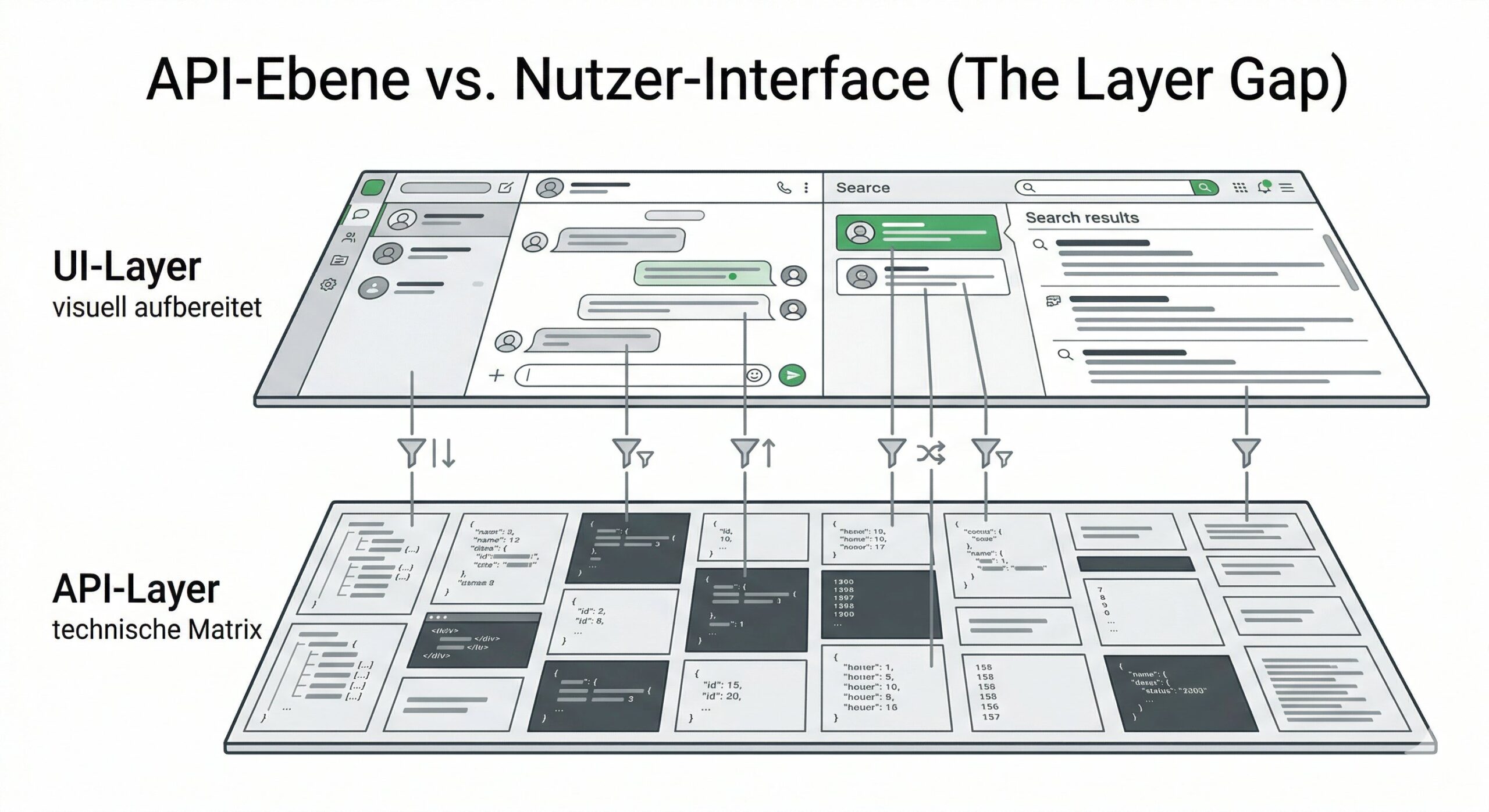

Die größte methodische Falle bei GEO- und LLMO-Prüfungen ist die Verwechslung von technischer Abrufbarkeit mit realer Sichtbarkeit. Wer nur APIs abfragt, bekommt Antworten – aber nicht zwangsläufig jene Antworten, die im Alltag die Wahrnehmung von Nutzern prägen. Zwischen API und Oberfläche liegen zusätzliche Schichten: andere Retrieval-Mechanismen, aktuellere Suchanbindungen, systemeigene Priorisierungen, Interface-Logiken und teils auch völlig andere Entscheidungspfade. Genau deshalb können API-Daten hilfreich sein, aber sie sind für sich genommen kein valider Ersatz für eine realitätsnahe Sichtbarkeitsprüfung.

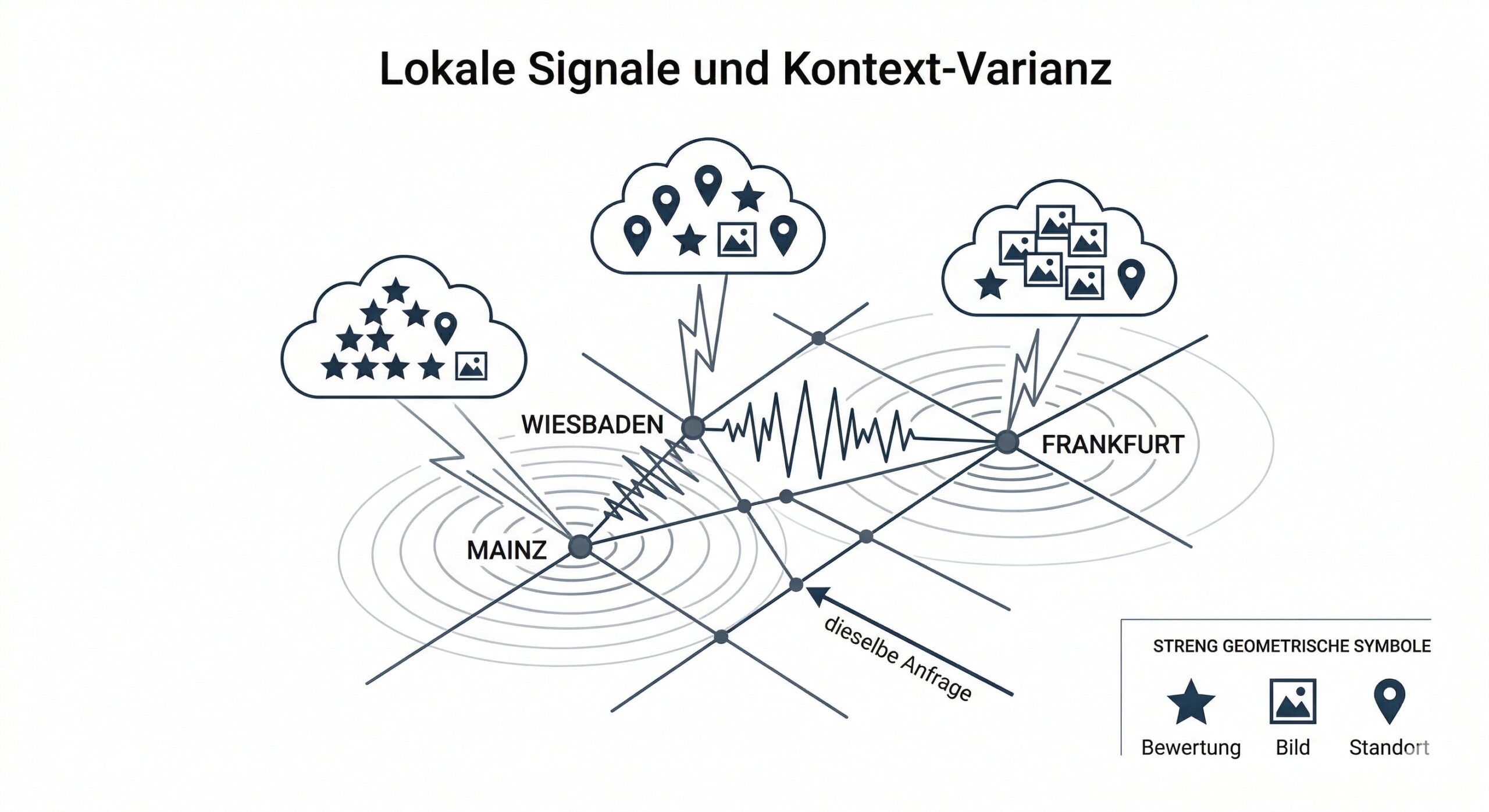

Das wird besonders deutlich bei lokalen und transaktionalen Suchen. Fragt ein Nutzer etwa aus Mainz nach einem Rohrreiniger in Weisenau oder aus Frankfurt nach einem guten Handwerker für eine Türreparatur, dann spielen plötzlich andere Signale hinein als bei einer reinen Modellabfrage. Bewertungen, lokale Referenzen, Bilder, aktualisierte Inhalte, Erwähnungen auf Drittplattformen und die allgemeine Klarheit der digitalen Spuren wirken zusammen. Wer nur im Telefonbuch steht oder eine veraltete Website mit austauschbaren Texten besitzt, wird in solchen Kontexten sehr häufig untergehen – selbst dann, wenn das Unternehmen fachlich hervorragend ist.

Hinzu kommt, dass dieselbe Anfrage je nach System vollkommen anders beantwortet werden kann. ChatGPT, Gemini, Claude, Perplexity und Google AI Overviews besitzen unterschiedliche Stärken, Eigenheiten und Suchzugriffe. Ein sauberer GEO-Check betrachtet deshalb nicht ein einzelnes Resultat, sondern Antwortmuster über mehrere Systeme, Standorte und Zustände hinweg. Erst daraus entsteht eine belastbare Aussage darüber, in welchem Relevanzbracket sich eine Marke wirklich bewegt.

| Prüfansatz | Was er liefert | Wo die Schwäche liegt |

|---|---|---|

| Nur API-Abfrage | Schnelle, gut automatisierbare Modellantworten | Oft kein realistisches Abbild der Nutzeroberfläche |

| UI-basierter GEO-Check | Nutzungsnahe Sichtbarkeit über echte Interfaces | Methodisch aufwendiger, nur teilautonom skalierbar |

| Großes LLMO-Audit | Tiefe Ursachenanalyse plus Maßnahmenarchitektur | Benötigt deutlich mehr Daten, Zeit und Interpretation |

Wer sich mit den strukturellen Hintergründen befassen möchte, findet dazu auch unser Whitepaper: Local GEO – Lokale Optimierung für die KI-Suche und den Fachbeitrag GEO-Strategie für WordPress. Für die historische Rückschau nutzen wir je nach Fall unter anderem bspw. die Wayback Machine.

Screenshot der Wayback Machine während einer Test-Recherche zu unserer alten Webseite www.mainzwebdesign.de

So läuft ein GEO-Check konkret ab Der kurze Check als realitätsnahe Oberflächenanalyse

Ein GEO-Check ist der erste belastbare Anhaltspunkt, wo ein Unternehmen im generativen Suchraum gerade steht. Dabei geht es nicht um die Illusion absoluter Präzision, sondern um eine fachlich saubere Näherung an die Sichtbarkeitsrealität. Wir definieren zunächst den Suchraum: Welche Leistungen, Probleme, Stadtbezüge, Vergleichssituationen und Empfehlungsanfragen sind für das Unternehmen überhaupt relevant? Danach formulieren wir Such- und Fragemuster, die reale Nutzer plausibel verwenden würden – nicht nur marketingglatte Headterms, sondern echte Anfrageformen.

Im zweiten Schritt wird das Prüfsetup variiert. Je nach Zielmarkt und Fragestellung betrachten wir Abfragen aus unterschiedlichen Regionen, mit und ohne Login, im Browser und in App-nahen Konstellationen. Gerade diese Variation ist wichtig, weil sich die Systeme in generativer Suche nicht wie ein starrer Rankinger auslesen lassen. Statt zehn statischen Positionen gibt es vielmehr Relevanzbrackets: Bereiche erhöhter Wahrscheinlichkeit, in denen einzelne Anbieter bevorzugt genannt werden. Im oberen Bracket befinden sich häufig nur zwei oder drei Namen – und genau dort entscheidet sich Aufmerksamkeit.

Die Rohdaten aus diesen Vergleichen fließen in eine Auswertungslogik, die Muster sichtbar macht: Wer wird überdurchschnittlich oft genannt? In welchem Kontext taucht ein Unternehmen auf? Wird es aktiv empfohlen oder nur am Rand erwähnt? Gibt es Systemunterschiede zwischen ChatGPT, Gemini, Claude, Perplexity und Google AI Overviews? Und vor allem: Welche Wettbewerber erscheinen wiederholt in den oberen Wahrnehmungszonen?

Ein Check beantwortet damit drei sehr praktische Fragen: Wo stehen wir heute? Wer steht vor uns? Welche offensichtlichen Signale fehlen uns? Genau deshalb ist er so wertvoll. Er liefert keine Nebelkerzen und keinen künstlichen Hype, sondern eine nüchterne, aber handlungsrelevante Einschätzung. Wer danach weitermachen möchte, kann die Ergebnisse in ein tieferes Audit überführen oder bereits erste Optimierungen ableiten – etwa an Content-Struktur, lokalen Trust-Signalen, Bildmaterial, FAQ-Ausbau, Referenzen oder Informationsarchitektur.

- Suchraum definieren: Themen, Leistungen, Städte, Vergleichsanfragen und Problemformulierungen abstecken.

- Nutzerfragen modellieren: echte Sprachmuster statt bloßer Keyword-Korsetts.

- Mehrere Systeme prüfen: ChatGPT, Gemini, Claude, Perplexity, Google AI Overviews und weitere relevante Oberflächen.

- Kontext variieren: Standorte, Login-Zustände und Zugangswege gegeneinander testen.

- Antworten aggregieren: Nennungen, Reihenfolgen, Begründungen und wiederkehrende Muster strukturiert auswerten.

- Erstmaßnahmen definieren: Welche Signale lassen sich unmittelbar verbessern?

Wer an der Architektur hinter solchen Maßnahmen arbeiten möchte, findet dazu ergänzend Informationsarchitekturen im Kontext von KI-SEO/LLMO/GEO und Von Content zu Kontext – Die neue Sichtbarkeitswährung im Netz als weiterführende interne Perspektiven.

Was ein kostenloser oder kompakter GEO-Check typischerweise sichtbar macht

| Er zeigt wer in Ihrem Themenfeld genannt wird, wie sichtbar Ihre Marke bereits ist, welche Wettbewerber dominieren und welche groben Signaldefizite direkt ins Auge fallen. | Er zeigt noch nicht alle historischen Ursachen, sämtliche Entitätskonflikte, jede Content-Lücke oder die exakte Priorisierung über Monate hinweg. Dafür braucht es das Audit. |

Wann aus dem Check ein großes LLMO-Audit werden muss Sobald nicht nur die Lage, sondern die Ursache entscheidend wird

Ein großes LLMO-Audit beginnt dort, wo einfache Sichtbarkeitsmessung nicht mehr ausreicht. Das ist meist dann der Fall, wenn eine Marke zwar grundsätzlich auffindbar ist, aber nicht in den oberen Relevanzbrackets auftaucht, wenn Wettbewerber systematisch bevorzugt werden oder wenn die eigenen Signale widersprüchlich, schwach oder historisch belastet sind. In diesem Stadium wird das Unternehmen nicht mehr nur „gecheckt“, sondern in seiner digitalen Gesamterscheinung auseinandergenommen.

Ein solcher Audit-Prozess schaut in der Regel mehrere Jahre zurück. Wir prüfen historische Versionen der Website, alte Leistungsdarstellungen, frühere Schwerpunktsetzungen, Relaunch-Spuren, inaktive Phasen, Branchenverzeichnisse, Reviews, Rezensionen, Erwähnungen, Medienfragmente, Profile und all jene digitalen Partikel, aus denen Maschinen im Laufe der Zeit ein Bild formen. Diese Rückwärtssuche ist deshalb so wichtig, weil Trust in generativen Systemen selten aus einem einzigen Moment entsteht. Vertrauen ist oft die Summe aus Konsistenz, Wiederholung und Nachweisbarkeit.

Parallel dazu wird eine Wettbewerbskarte erstellt. Wer wird in unserem Umfeld regelmäßig zitiert? Warum genau diese Anbieter? Welche Signale besitzen sie, die wir nicht besitzen? Sind sie lokaler verankert, publizieren sie konsequenter, haben sie stärkere Bewertungen, klarere Entitäten, mehr Cases, bessere Bilder oder verständlichere Leistungsprofile? Erst wenn diese Vergleichsebene sauber vorliegt, entsteht ein realistischer Maßnahmenplan.

Aus den beiden Ebenen – Innenanalyse und Wettbewerbsanalyse – wird anschließend eine operative Roadmap gebaut. Sie beantwortet nicht abstrakt, was „man mal tun sollte“, sondern priorisiert konkret: Welche Inhalte fehlen? Welche Themen müssen in welcher Reihenfolge publiziert werden? Wo müssen Website, Profile und Drittplattformen harmonisiert werden? Welche Trust-Signale lassen sich schnell stärken? Welche Assets müssen erst erzeugt werden, damit ein Unternehmen maschinell besser lesbar und zitierbar wird?

Genau hier liegt der Unterschied zwischen netter Beratung und echter Auditarbeit. Ein Audit arbeitet nicht nur mit Meinungen, sondern mit hunderten Datenpunkten, die strukturiert ausgewertet und gegeneinander interpretiert werden. Der konkrete Aggregationsmechanismus ist naturgemäß proprietär, aber das Ziel ist klar: Die Marke soll für KI-Systeme vertrauenswürdiger, eindeutiger und empfehlenswerter werden als die relevanten Wettbewerber.

Die Website bleibt zentral – aber ihre Rolle verändert sich radikal Nicht mehr nur Lesefläche für Menschen, sondern Referenzraum für Maschinen

Ein Punkt wird im Gespräch über generative Suche noch immer unterschätzt: die fortbestehende Bedeutung der Website. Viele Unternehmen fragen inzwischen sehr direkt, warum sie überhaupt noch in Inhalte, Informationsarchitektur und Webpräsenz investieren sollen, wenn Nutzer künftig seltener auf die Seite klicken. Die Antwort darauf ist simpel und unbequem zugleich: Die Website ist nicht obsolet – ihre Funktion verschiebt sich.

Früher war die Website primär dafür da, dass Menschen sie besuchen, lesen, verstehen und sich dann zu einer Handlung entschließen. In der Welt der KI-Suche passiert ein Teil dieser Vermittlungsarbeit bereits vorher. Die Maschine liest, interpretiert und verdichtet Informationen. Sie gibt dem Nutzer eine Entscheidungshilfe oder direkt eine Empfehlung. Das heißt aber nicht, dass die Website unwichtig wird. Im Gegenteil: Sie wird zum entscheidenden Referenzraum, aus dem die KI Informationen entnimmt, gegen andere Signale abgleicht und schließlich in Antworten überführt.

Das verändert auch die Erfolgslogik. Die Seite muss heute nicht nur „gut aussehen“, sondern klar erfassbar sein: Welche Leistungen werden angeboten? Für wen? In welchen Regionen? Mit welcher Erfahrung? Wodurch belegt? Mit welchen Kontaktpunkten? Welche Inhalte aktualisieren dieses Wissen laufend? Welche Bilder, Stories, Cases oder Hinweise machen das Profil konkret? Genau deshalb sind Beiträge wie GEO-Strategie für WordPress, Local GEO und Onpage-Optimierung 2026 nicht gegeneinander zu lesen, sondern als unterschiedliche Ebenen derselben Herausforderung.

Ein weiterer Irrtum lautet, man könne sich in diese neue Sichtbarkeit einfach einkaufen. Für viele generative Empfehlungssituationen existiert bislang gerade kein belastbares Werbeprogramm, das klassische Rankingmechanik ersetzt. Und selbst wenn sich hier künftig neue Formate entwickeln, bleibt die Vermutung stark, dass bei Wissensarbeit, Dienstleistersuche und erklärungsbedürftigen Angeboten weiche Informationssignale weiterhin das entscheidende Gewicht behalten werden. Man kann eine Anzeige buchen. Vertrauen kann man nicht buchen. Vertrauen muss digital lesbar werden.

Das ist auch der Grund, warum Publishing-Geschwindigkeit künftig so wichtig wird. Nicht im Sinn beliebiger Textmasse, sondern im Sinn einer organisatorischen Fähigkeit, Wissen schnell, konsistent und in lesbarer Form in die Systeme einzuspeisen. Wer relevante Entwicklungen, Cases, Fragen, Bilder und Einordnungen früh publiziert, schafft nicht nur Content, sondern Kontext. Und genau dieser Kontext ist in der KI-Suche die neue Sichtbarkeitswährung.

Wenn ein Nutzer dann von der KI bereits qualifiziert informiert wurde, greift wieder die klassische Conversion-Logik: Der Kontaktpunkt muss funktionieren, die Erreichbarkeit muss sauber sein, Formulare und Telefonnummern müssen passen, Barrieren müssen gering sein, Reaktionszeiten müssen stimmen. Bis zu diesem Punkt ändern sich die Regeln stark. Ab diesem Punkt gelten viele alte Wahrheiten weiter.

Die Website ist in der generativen Suche nicht mehr nur eine Zielseite für Klicks. Sie ist ein strukturierter Belegraum, aus dem KI-Systeme Vertrauen, Relevanz und Zitatfähigkeit ableiten.

Was in Zukunft besonders zählt

Nicht die lauteste Präsenz, sondern die schnellste und sauberste Einspeisung von belastbarem Wissen.

🧩 klare Entitäten • 📰 aktuelle Publikationen • 📍 lokale Signale • ⭐ Bewertungen • 🖼️ Bilder und Cases • ☎️ funktionierende Kontaktpunkte

Wie schnell zeigen sich Ergebnisse? Warum GEO und LLMO keine Wochenendmaßnahme sind

Seriöse Erwartungssteuerung gehört zwingend zu jedem GEO-Check und erst recht zu jedem großen Audit. Klassische Suchmaschinenoptimierung zeigt je nach Markt oft nach sechs bis acht Wochen oder innerhalb von zwei bis drei Monaten erste nachvollziehbare Bewegungen. In generativen Suchsystemen dauert vieles länger. Die Systeme reagieren langsamer, die Signalaufnahme ist träger und die Wirkung entsteht häufig erst dann, wenn mehrere Ebenen konsistent zusammenspielen. Deshalb sollte man hier nicht in Tagen oder einzelnen Prompt-Screenshots denken.

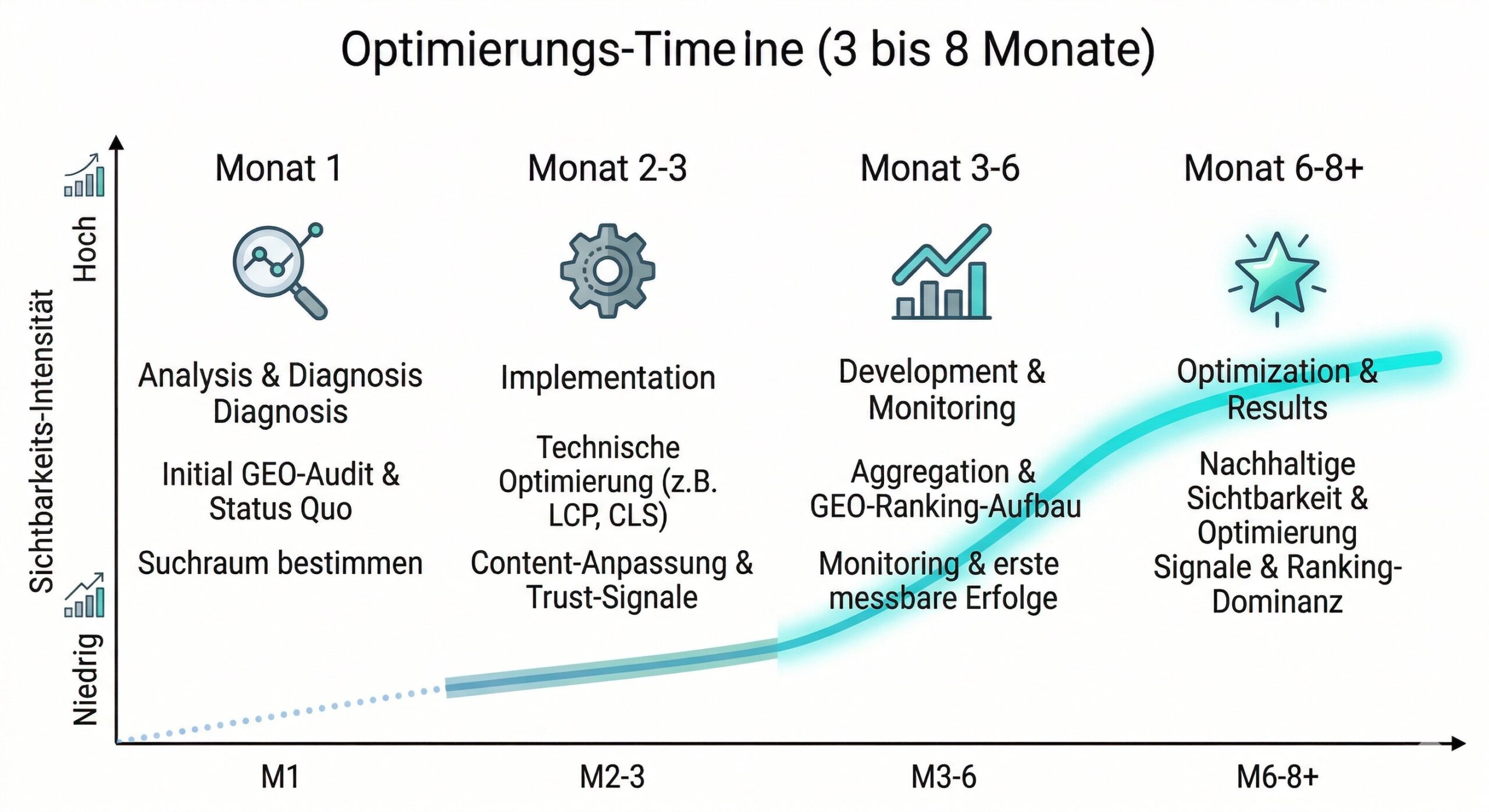

In der Praxis sehen wir erste belastbare Resultate häufig nach drei bis sechs Monaten, in anspruchsvolleren Fällen eher nach sechs bis acht Monaten. Genau deshalb ist ein Audit keine Kosmetik, sondern eine mittelfristige Optimierungsmaßnahme. Wer früh anfängt, erkauft sich nicht einfach Sichtbarkeit, sondern baut einen Vorsprung in Datenlage, Vertrauen und Verarbeitbarkeit auf. Und dieser Vorsprung lässt sich nur schwer nachholen, wenn Wettbewerber bereits über Monate hinweg sauber publiziert, strukturiert und signalisiert haben.

Das Entscheidende dabei: Ein guter Prozess misst Fortschritt nicht eindimensional. Es geht nicht nur darum, ob Sie genannt werden, sondern wie, wo, in welcher Argumentationslogik, neben welchen Wettbewerbern und mit welcher Beständigkeit über Systeme hinweg. Genau darin liegt der Unterschied zwischen kurzfristigem KI-Aktionismus und nachhaltiger generativer Sichtbarkeitsarbeit.

Fazit: Ein GEO-Check ist der richtige Einstieg, wenn Sie eine belastbare erste Einordnung brauchen. Ein großes LLMO-Audit ist der richtige Schritt, wenn Sie nicht nur mitspielen, sondern in den relevanten Wahrnehmungsbrackets systematisch nach oben wollen.

Der größte Denkfehler ist die Annahme, man könne generative Sichtbarkeit wie klassische Rankings behandeln. Ein paar API-Abfragen, ein paar Screenshots und ein Score wirken bequem, sind aber oft methodisch zu dünn. Der eigentliche Prüfgegenstand ist nicht die isolierte Modellantwort, sondern die Nutzerrealität in echten Interfaces.